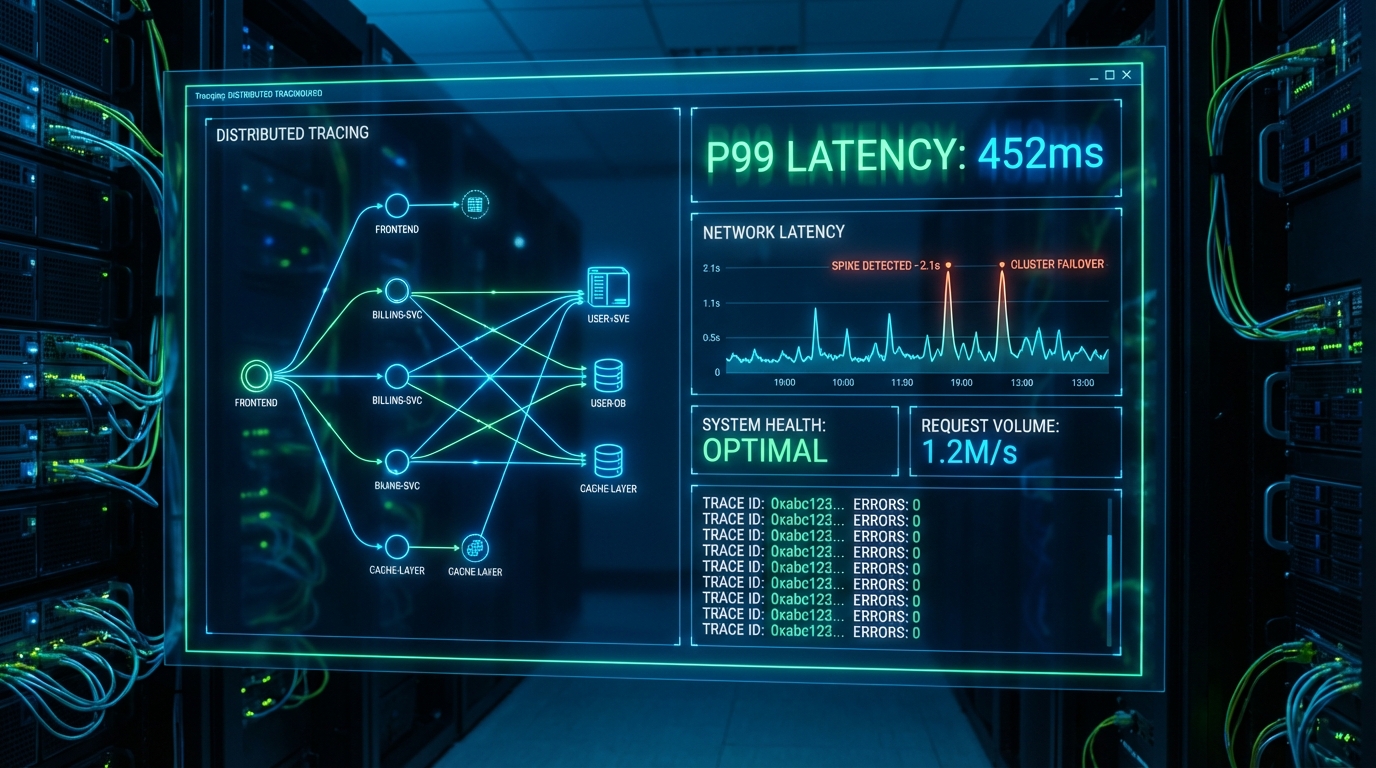

CPU 38%, 에러율 0.2%, P99 지연 시간 1.4초. 인프라 대시보드는 완벽한 '정상(Green)'을 가리키지만, 실제 사용자는 타임아웃을 겪고 이탈한다. Erythix가 Dev.to의 최근 아티클에서 지적했듯, 이는 분산 추적(Distributed Tracing) 없이 단순 집계 메트릭에 의존하는 ML 파이프라인이 마주하는 전형적인 맹점이다. LLM API 호출, 데이터 전처리, 그리고 RAG 인덱싱이 결합된 생성형 AI 백엔드는 단일 함수가 아닌 복잡한 분산 시스템이다. 평균값(Mean)과 단순 P99 지표는 개별 요청이 거치는 생애 주기(Life cycle)를 파악하지 못해 병목의 진짜 원인을 은폐한다.

가장 치명적인 착시는 GPU 활용도(Utilization)와 피처 스토어(Feature Store) 캐시에서 발생한다. 75%의 GPU 활용도는 리소스가 적절히 사용되는 것처럼 보이지만, 분산 추적으로 inference 스팬(Span)을 분리해보면 실제 모델 연산(forward_pass_ms)보다 대기열(queue_wait_ms)에서 소모되는 시간이 더 길 수 있다. 또한, 피처 스토어의 캐시 히트율이 99%라도, 1%의 DB 폴백(Fallback)이 발생할 때 지연 시간이 50배 폭증한다면 이는 시스템 전체의 P99를 파괴한다. 독립적으로 측정되지 않은 구성 요소는 비용 대비 성능 최적화의 방향타를 잃게 만든다.

Young Gao가 분석한 AI 백엔드 통합 패턴과 결합해 보면 아키텍처의 취약점은 더 명확해진다. LLM의 비결정적(Non-deterministic) 출력 특성으로 인해 백엔드에서는 구조화된 데이터(JSON) 파싱 실패 시 '조용한 재검증(Silent revalidations)'이 빈번하게 일어난다. HTTP 에러율은 0%로 기록되지만, post_processing 스팬에서는 재요청으로 인해 지연 시간이 2~3배로 치솟는다. 이는 모델의 성능 저하(Degradation)와 환각(Hallucination) 증가를 알리는 강력한 선행 지표임에도, OpenTelemetry 기반의 추적 인프라가 없다면 사용자의 컴플레인이 접수된 후에야 사후 분석에 들어가게 된다.

따라서 프로덕션 환경에서는 철저한 정량적 관점의 토큰 통제와 지연 시간 방어 패턴이 필수적이다. TTFT(Time To First Token)를 줄여 체감 지연 시간을 방어하는 SSE(Server-Sent Events) 기반 스트리밍은 기본이며, LLM 프로바이더 장애에 대비한 하드 타임아웃(Hard timeout)과 Graceful Degradation(예: 텍스트 검색으로의 폴백) 전략이 수반되어야 한다. 또한, 툴 호출(Tool Call)이 빈번한 에이전트 환경에서는 API 게이트웨이 단에 Redis 기반의 비용 통제(Cost Guard) 미들웨어를 두어 사용자별 토큰 예산 초과를 엄격히 차단해야 하며, 프롬프트 해시(Hash) 기반의 캐싱으로 동일한 추론에 대한 GPU 큐 대기 시간과 토큰 비용을 0으로 수렴시켜야 한다.

생성형 AI 시스템의 TCO(총소유비용)와 신뢰성은 모델의 파라미터 크기나 벤치마크 점수가 아니라, 파이프라인의 가시성(Observability)에 의해 결정된다. 단일 라우터에 맹목적으로 LLM API를 붙이던 PoC 수준의 개발을 지나, 이제는 AgentOps 수준의 분산 추적 체계를 기본값으로 구축해야 할 때다. 각 컴포넌트의 지연 시간과 토큰 소모량을 마이크로초 및 단위 달러 스케일로 독립 평가하지 못하는 AI 시스템은 결국 예측 불가능한 클라우드 청구서와 붕괴된 P99 지연 시간이라는 기술 부채로 돌아올 것이다.