단일 GPT-4 API 호출 비용 $0.03. 이를 하루 1만 건씩 6개월간 실행하면 5만 달러(약 6,600만 원)가 증발한다. 대규모 언어 모델(LLM)의 무분별한 프로덕션 도입이 초래하는 '단가 붕괴' 현상이다. 최근 기업용 AI 아키텍처의 중심축은 파라미터 경쟁에서 벗어나, SLM(소형 언어 모델) 기반의 지식 증류(Knowledge Distillation)와 MoE(Mixture of Experts)를 결합한 극단적인 비용-성능 트레이드오프 최적화로 이동하고 있다.

Dev.to의 최신 SLM 가이드에 따르면, 14B 이하의 모델을 활용하는 가장 효율적인 전략은 대형 교사(Teacher) 모델의 추론 결과를 학생(Student) 모델에 이식하는 '증류' 기법이다. 여기서 파인튜닝의 일반화 성능(Generalization)을 가르는 핵심 변수는 데이터의 양이 아닌 노이즈 비율이다. 5만 개의 정제되지 않은 데이터보다, 포맷이 일관되고 PII(개인식별정보)가 제거된 5,000개의 고품질 합성 데이터가 프로덕션 환경의 사실성(Factuality) 지표에서 압도적으로 높은 점수를 기록한다. 특히 3.8B 크기의 Phi-4 Mini가 SimpleQA 벤치마크에서 91.1%를 달성한 것은, 도메인 특화 태스크에서 파라미터 크기는 더 이상 유의미한 성능 변수가 아님을 통계적으로 입증한다.

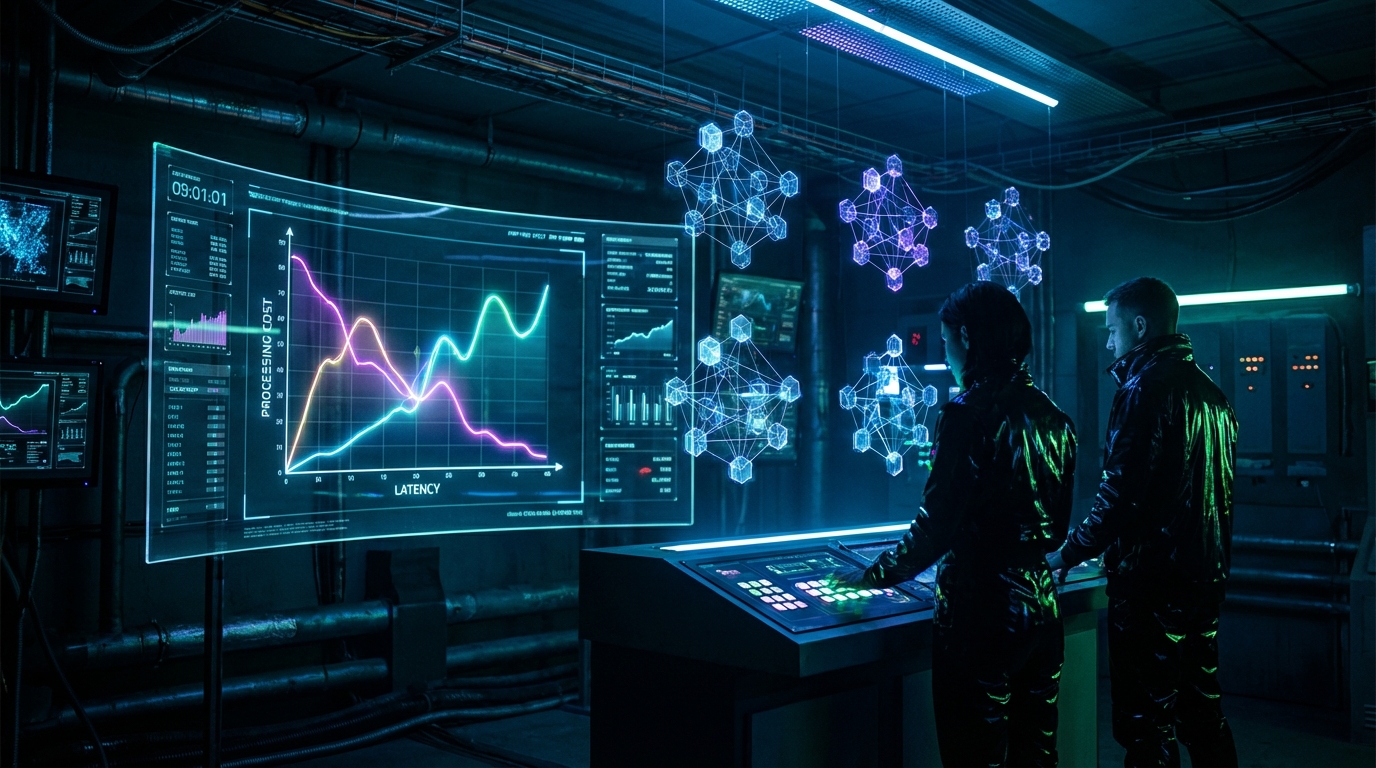

여기에 추론 지연 시간(Latency)을 통제하기 위해 도입되는 아키텍처가 바로 미스트랄 스몰 4(Mistral Small 4)가 채택한 MoE 구조다. 이 모델은 총 1,190억 개의 파라미터를 갖췄지만, 실제 토큰당 활성화되는 매개변수는 60억 개(6B)에 불과하다. 이는 프로덕션 서빙 시 P99 지연 시간을 극적으로 단축시키는 수학적 근거가 된다. 특히 주목할 지점은 '추론 노력(reasoning_effort)'이라는 동적 하이퍼파라미터의 도입이다. 쿼리의 복잡도에 따라 연산량을 동적으로 라우팅(Routing)함으로써, 시스템 엔지니어는 API 비용과 응답 시간이라는 두 가지 종속 변수를 정밀하게 제어할 수 있게 되었다.

프로덕션 환경에서 이 두 기술의 결합이 시사하는 바는 명확하다. LoRA와 4비트 양자화(QLoRA)를 활용하면 RTX 4090(24GB) 단일 노드에서도 10달러 미만의 컴퓨팅 비용으로 파인튜닝 파이프라인을 구축할 수 있다. 더 나아가 미스트랄이 제시한 vLLM 및 SGLang 최적화 사례처럼, 서빙 프레임워크 단에서의 처리량(Throughput) 개선이 동반된다면 기업은 데이터 주권을 유지하면서도 상용 API 대비 1/10 수준으로 TCO(총소유비용)를 압축할 수 있다.

결론적으로, 생성형 AI 시스템의 성공 여부는 '얼마나 큰 모델을 쓰는가'가 아니라 '단위 토큰당 연산 비용(FLOPs/token)을 얼마나 정량적으로 제어할 수 있는가'에 달려 있다. SLM 증류를 통해 도메인 지식을 압축하고, MoE 아키텍처로 추론 병목을 해소하는 하이브리드 접근법은 기업용 AI 엔지니어링의 표준 베이스라인이 될 것이다. 이제 A/B 테스트의 핵심 지표는 표면적인 텍스트 생성 품질(BLEU/ROUGE)을 넘어, 응답 지연 시간과 GPU 메모리 활용도 간의 상관관계 분석으로 확장되어야 한다.