AI가 빠를수록 내가 느려지는 역설

솔직하게 물어보자. 지난달에 AI가 짜준 코드, 지금도 자신 있게 설명할 수 있는가?

dev.to에 올라온 DevMem 프로젝트 포스트의 첫 문장이 인상 깊었다. 개발자가 2주 전에 자신이 머지한 모듈을 디버깅하다 20분 동안 낯선 코드를 들여다봤다는 고백. 타인이 짠 것처럼 느껴졌다. 실제로는 AI가 짜고 자신이 리뷰 후 넘어간 코드였다.

이 문제를 우리는 보통 "문서화 부족"으로 정리하고 넘어간다. 그런데 그 프레임이 틀렸다. 진짜 문제는 개발자도 컨텍스트 윈도우가 있다는 점이다. AI가 코드를 쏟아내는 속도가 인간의 기억 대역폭을 초과하기 시작했다.

컨텍스트 소실: 속도의 부작용

AI 코딩 도구의 생산성 이점은 명확하다. 하지만 그 이점이 팀 전체로 전파되려면, 생성된 코드가 팀 누구에게나 — 그리고 다음에 투입될 AI 에이전트에게도 — 충분히 이해 가능해야 한다. 그렇지 않으면 AI가 빠르게 쌓은 코드베이스는 2주 후 팀 전체의 속도를 갉아먹는 기술 부채가 된다.

DevMem은 이 문제를 커밋 훅에서 해결하려 한다. 코드가 바뀌는 유일하게 확실한 순간 — 커밋 — 에 문서를 자동으로 패치하는 방식이다. devmem capture를 커밋마다 실행하면 .devmem/ 폴더에 모듈별 구조, API 표면, 최근 변경 이력이 살아있는 지식 베이스로 유지된다. 흥미로운 부수 효과는, 이 폴더가 Cursor나 Copilot 같은 AI 도구의 컨텍스트로도 즉시 활용된다는 점이다. 정확한 현재 아키텍처를 읽은 AI는 추측을 덜 하고 더 정확한 제안을 낸다. 팀원과 AI 도구가 같은 지식 베이스를 공유하는 구조다.

물론 한계는 있다. 비표준 프로젝트 구조에서는 모듈 탐지 휴리스틱이 실패하고, 캡처를 2주 건너뛰면 쿼리 품질이 급격히 떨어진다. 하지만 방향성은 옳다. 문서를 개발의 결과물이 아니라 연속적인 부산물로 만드는 것, 이것이 AI-First 팀이 컨텍스트 소실을 막는 구조적 접근이다.

도구 분담: 이해와 실행을 나눠라

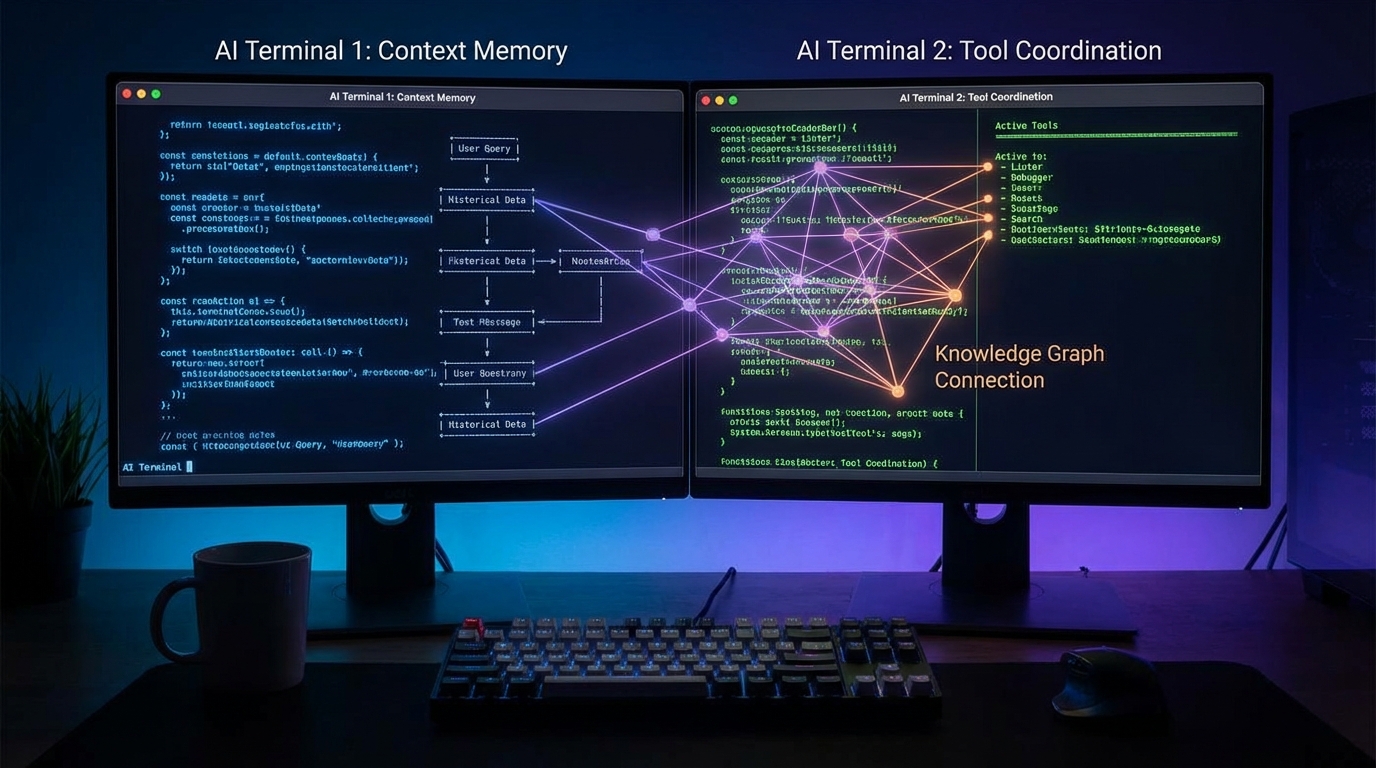

컨텍스트를 유지하는 것과 함께, AI-First 팀이 맞닥뜨리는 두 번째 운영 질문은 어떤 AI 에이전트에게 무엇을 맡기느냐다.

20개 이상의 Spring Boot 마이크로서비스를 운영하는 Java 백엔드 개발자가 dev.to에 공유한 워크플로우는 이 질문에 실용적인 답을 제시한다. 그의 결론은 단순하다. Claude Code는 이해, Codex는 실행.

복잡한 버그나 레거시 비즈니스 로직 추적은 Claude Code가 맡는다. 다층 컨텍스트를 따라가며 "왜 이게 이 시나리오에서 실패하는가"를 설명하는 데 강점이 있다. 반면 테스트 생성, 반복 편집, 병렬 처리 가능한 기계적 작업은 Codex가 처리한다. 무거운 모델(Opus, gpt-5.4)은 정말 막혔을 때만 꺼낸다. 추론 대기 시간이 일상 작업의 흐름을 깨기 때문이다.

CHANGES.log: 에이전트 간 핸드오프를 설계하라

이 워크플로우에서 가장 실용적인 부분은 CHANGES.log다. Claude Code가 작업 중 슬로다운되거나 중단될 때, Codex로 전환하면서 컨텍스트를 다시 설명하는 데 낭비되는 시간을 없애기 위한 장치다. 코드 변경 로그가 아니라 태스크 상태 로그로 운영된다.

CLAUDE.md는 Claude Code 전용 행동 규칙, AGENTS.md는 Codex 전용, CHANGES.log는 두 에이전트 사이의 공유 상태 레이어. 프로젝트 컨텍스트는 같되 행동 규칙은 분리하는 이 구조가 예상보다 훨씬 중요하게 작동했다고 저자는 강조한다.

이것을 팀 단위로 확장하면 시사점이 명확해진다. AI 에이전트를 단순히 "도구"로 쓰는 게 아니라, 각 에이전트에게 명확한 역할과 인터페이스를 부여하는 에이전트 역할 설계가 필요하다. 도구 선택보다 그 도구들을 어떻게 조율하느냐가 생산성을 결정한다.

통합 세금: AI를 실제 시스템과 연결할 때의 숨겨진 비용

컨텍스트를 유지하고 도구를 잘 분담해도, AI가 실제 시스템과 연결되는 순간 다른 종류의 비용이 발생한다. dev.to의 MCP 시리즈 첫 번째 글이 이 문제를 정면으로 다룬다.

5개 AI 애플리케이션, 각각 3개의 시스템 연동. 총 15개의 커스텀 인테그레이션. 통합당 40시간을 가정하면 600시간. 기능 하나 안 만들고, 사용자가 체감하는 변화 하나 없이 소진되는 엔지니어링 비용이다. 저자는 이것을 통합 세금(Integration Tax)이라 부른다.

AI는 이 문제를 악화시키는 두 가지 속성을 가진다. 첫째, 학습 컷오프 이후의 실시간 데이터를 알지 못한다. 둘째, 이해와 실행 사이의 갭—즉, 데이터베이스를 조회하거나 API를 실제로 호출하는 행동—은 개발자가 연동 코드를 직접 작성하기 전까지 채워지지 않는다. 모델이 아무리 좋아져도, 연결 레이어가 해결되지 않으면 팀은 새로운 모델을 도입할 때마다 이 세금을 반복 납부한다.

MCP(Model Context Protocol)는 이 N×M 통합 문제를 시스템이 자신의 기능을 표준 방식으로 선언하고, AI 에이전트가 런타임에 이를 발견·활용하는 구조로 해결하려 한다. 아직 초기 단계지만 방향은 분명하다. 연동 코드를 한 번 작성하면 어떤 AI 에이전트든 재사용 가능한 인프라.

시사점: 속도보다 지속성을 설계하라

세 가지 소스가 가리키는 곳은 같다. AI-First 팀의 다음 과제는 더 빠른 생성이 아니라 지속 가능한 운영 구조다.

내일 당장 팀에 적용할 수 있는 세 가지 체크리스트:

-

커밋 단위 컨텍스트 유지: 문서를 별도 태스크로 처리하지 말고, 커밋 훅에 붙여라. DevMem 같은 도구를 도입하거나, 최소한 커밋 메시지 컨벤션을 AI 에이전트가 읽을 수 있는 형식으로 구조화하라.

-

에이전트 역할 분리: Claude Code와 Codex(또는 팀이 쓰는 어떤 도구든)의 역할을 명시하라. 이해·추론은 A, 반복·병렬은 B. 두 에이전트가 같은 인스트럭션 파일을 공유하게 두지 마라.

-

통합 비용을 명시적으로 측정하라: 다음 AI 기능을 기획할 때 연동 작업 시간을 별도 항목으로 계상하라. 눈에 보이지 않으면 줄일 수도 없다.

전망: AI 팀의 경쟁력은 '연결 설계'로 이동한다

모델 성능은 빠르게 상향 평준화된다. 6개월 후면 지금의 "고성능 모델"이 기본값이 될 것이다. 그 시점에 팀 간 생산성 격차를 만드는 것은 어떤 AI를 쓰느냐가 아니라, AI가 팀의 컨텍스트를 얼마나 잘 유지하고, 에이전트 간 핸드오프가 얼마나 매끄럽고, 실제 시스템과의 연결 비용이 얼마나 낮으냐다.

빨리 짜는 것에서 지속 가능하게 짜는 것으로. AI 워크플로우의 다음 진화는 생성 속도가 아니라 운영 구조에서 결정된다.