경량·고속 LLM이 ‘기술 업데이트’로 보이면 반쪽만 본 겁니다. Gemini 3.1 Flash-Lite, GPT-5.4 mini/nano 같은 컴팩트 모델의 핵심은 성능이 아니라 단가(COGS)와 지연시간(P99)을 동시에 낮춰 제품의 가격 정책 자체를 바꿀 수 있다는 점입니다(dev.to가 정리한 트렌드와 Google DeepMind·OpenAI 발표를 종합).

왜 이게 성장 이슈냐면, 지금까지 많은 AI 제품은 “유료 전환 전까지는 최대한 사용을 제한”해야 했습니다. 요청 1건이 곧 비용이었으니까요. 그런데 경량 모델이 깔리면 전략이 뒤집힙니다. 무료/저가로 더 많이 쓰게 만들고(퍼널 확장), 그 트래픽을 다른 방식으로 수익화하는 선택지가 현실화됩니다.

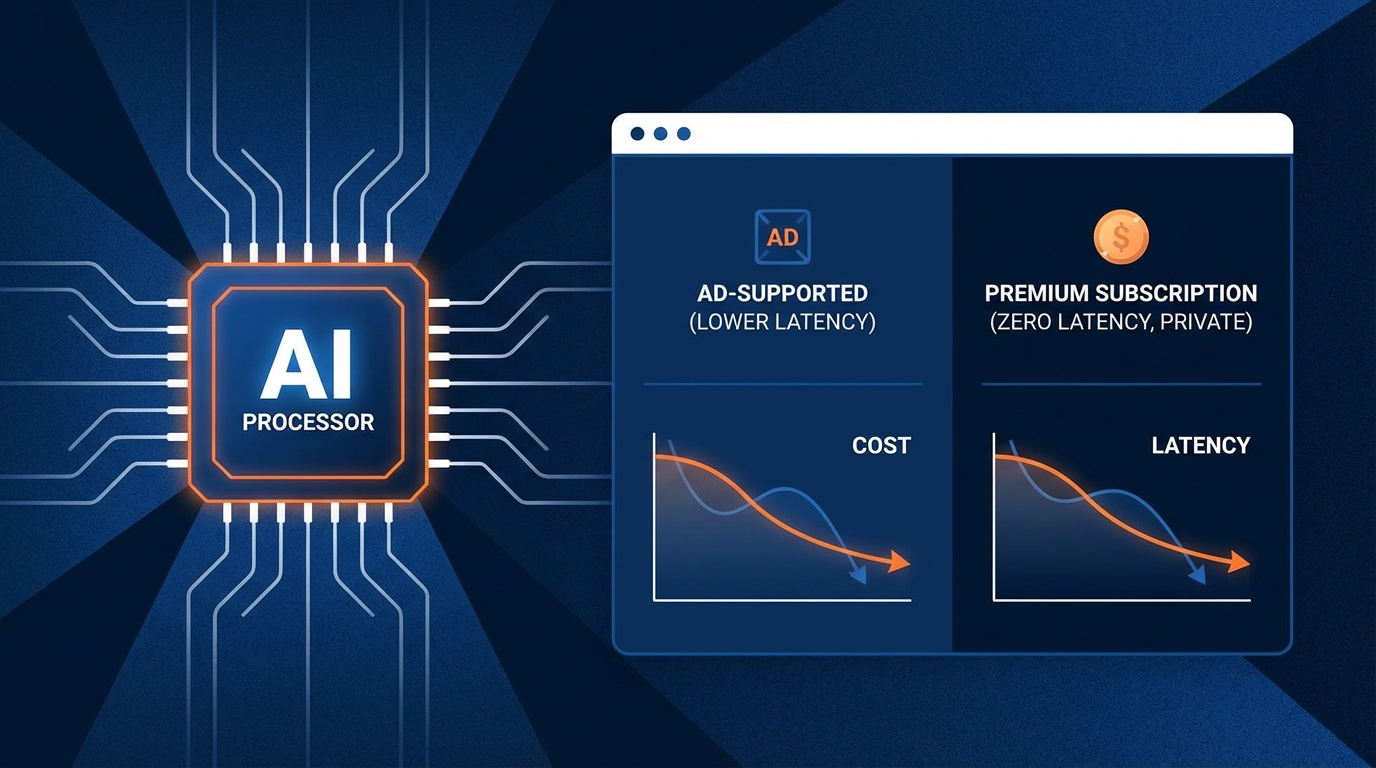

여기에 결정적인 신호가 하나 더 붙었습니다. 로이터를 인용한 비즈월드 보도에 따르면 OpenAI가 ChatGPT 무료/저가 요금제에 광고 도입을 검토 중입니다. 이건 ‘구독 단일 모델’의 한계를 인정하고, 생성형 AI가 검색·SNS처럼 광고/하이브리드 모델로 이동할 수 있다는 업계 신호로 읽어야 합니다. 인프라 비용이 사용량에 비례해 커지는 구조에서, 이용자 성장을 멈추지 않으려면 수익원도 다변화되어야 하니까요.

맥락을 성장 관점으로 해석하면 이렇게 정리됩니다. (1) 경량 LLM은 TTV(Time-to-Value)를 줄입니다: 툴 호출·에이전트 루프에서 LLM 콜이 병목이었는데, 지연이 내려가면 ‘완료 경험(Completion)’이 빨라져 D1이 올라갑니다. (2) 경량 LLM은 무료 기능의 한도를 넓힙니다: “하루 5회” 같은 인위적 제한 대신 “광고를 보면 20회” 같은 유연한 레버가 생깁니다. (3) 광고는 단순 노출이 아니라 사용 의도 기반 타게팅이 가능해집니다: 대화 내용은 곧 intent 데이터이고, 이는 전통적 디스플레이보다 전환 효율을 만들 여지가 큽니다(물론 프라이버시/정책 설계가 전제).

시사점은 명확합니다. 앞으로 경쟁력은 ‘모델 성능’보다 퍼널을 어떤 가격 곡선으로 설계하느냐에서 갈릴 확률이 높습니다. 경량 모델이 기본 모델이 되면, 프리미엄 구독은 “더 똑똑함”만이 아니라 “광고 제거 + 신뢰(보안/데이터 통제) + 고가치 워크플로우” 패키지로 재정의됩니다. 즉, LTV를 구독 ARPU 하나로만 만들지 말고, Ads ARPU(또는 제휴/리드 수익)를 함께 쌓는 구조가 표준이 될 수 있습니다.

실행 관점에서 팀이 바로 할 일도 보입니다. 첫째, 라우팅을 전제로 한 기능 설계: 기본은 mini/nano급으로 ‘즉시 응답’하고, 결제/법무/민감 작업만 상위 모델로 올리는 멀티모델 티어링이 무료 퍼널의 원가를 결정합니다. 둘째, 광고형 수익화는 UX보다 먼저 가드레일이 필요합니다: 대화 흐름을 끊는 배너가 아니라, 작업 맥락을 해치지 않는 “추천/스폰서 답변” 형태가 되어야 리텐션을 덜 깎습니다. 셋째, 측정은 AARRR로 단순화: Activation(첫 완료), Retention(재완료), Revenue(Ads ARPU + 구독), Referral(공유)로 두고, 특히 광고 도입 시 리텐션 하락 폭 대비 ARPU 상승분을 주 단위로 추적해야 합니다.

전망: 경량 LLM은 AI를 ‘기능’에서 ‘유통’으로 바꿉니다. 비용과 지연이 내려갈수록 AI는 더 많은 표면(앱, 웹, 엣지, 에이전트)에 깔리고, 그 표면 위에서 수익모델은 구독 일변도에서 광고·제휴·커머스·하이브리드로 갈라집니다. OpenAI의 광고 검토는 그 전환의 선명한 예고편입니다(비즈월드/로이터). 다음 분기 당신의 그로스 과제는 하나로 수렴합니다. “무료 사용량을 얼마나 키워도 COGS가 무너지지 않는가, 그리고 그 트래픽을 어떤 수익원으로 연결할 것인가.”