프로덕션 환경에서 수백 개의 AI 에이전트를 동시 병렬로 실행할 때, 아키텍처는 필연적으로 두 가지 치명적인 병목에 직면합니다. 첫째는 인프라 수준의 컴퓨팅 격리(Isolation) 오버헤드에 따른 P99 지연 시간의 붕괴이며, 둘째는 각 에이전트의 독립적 실행으로 인해 발생하는 컨텍스트 유실 및 토큰 중복 소모 비용입니다. 최근 Dev.to에 공개된 두 가지 실증적 사례—'Zeroboot'의 1ms 미만 샌드박싱과 'Notion MCP'를 활용한 93개 서브 에이전트 오케스트레이션—는 이 트레이드오프를 OS 커널과 프로토콜 단위에서 정량적으로 통제하는 해법을 제시합니다.

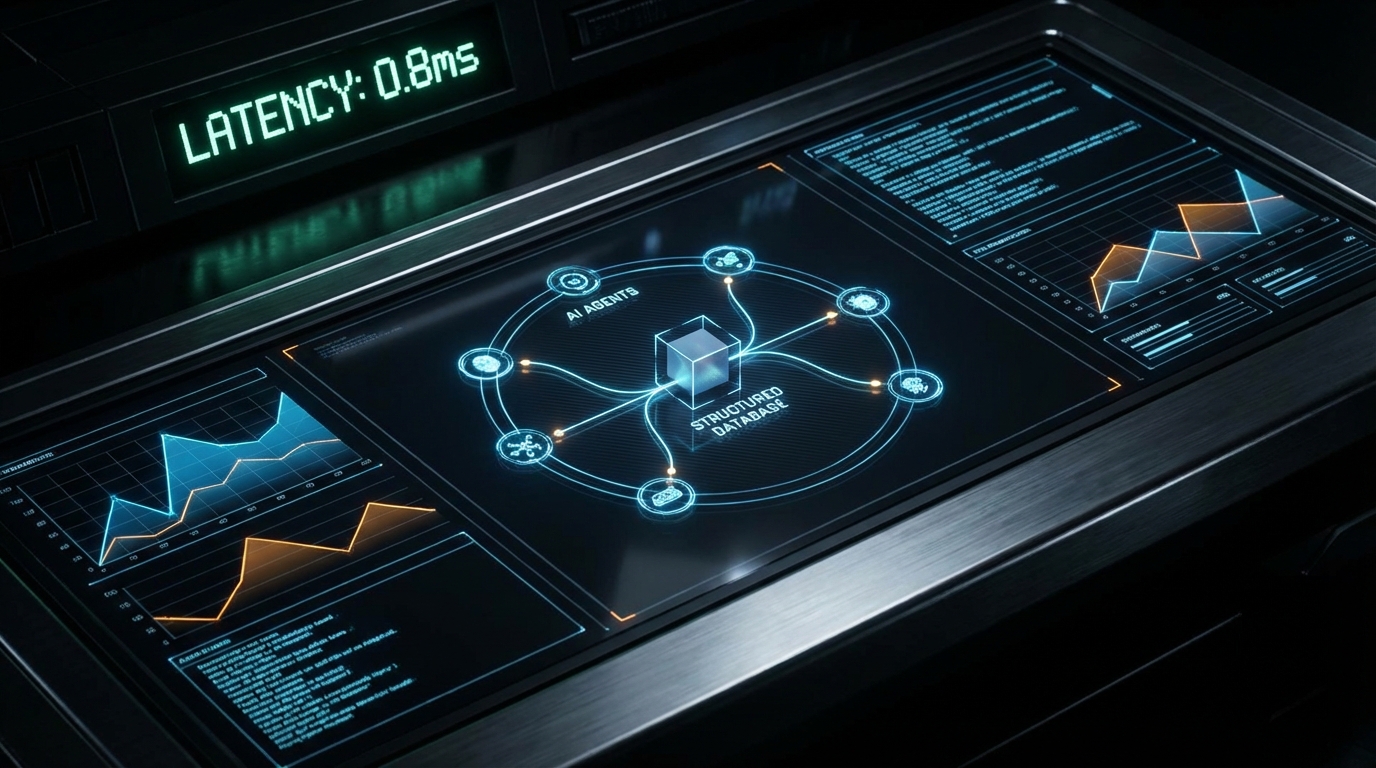

에이전트가 신뢰할 수 없는 코드나 임의의 프롬프트를 실행하려면 독립된 환경이 필수적입니다. 그러나 기존의 도커(Docker) 컨테이너는 15~30초의 콜드스타트를 유발하며, AWS Firecracker 수준의 마이크로 VM조차 5~10ms의 지연을 발생시킵니다. 이는 실시간 대화형 에이전트 시스템에서 장애 복구(Recovery)나 A/B 테스트 시 치명적인 레이턴시 스파이크를 초래합니다. Zeroboot는 Linux의 fork() 시스템 콜과 Copy-on-write(CoW) 메모리 관리 기법을 차용하여 이 문제를 우회합니다. 전체 메모리를 복제하는 대신 메타데이터만 복사함으로써, VM 샌드박스 생성 시간을 0.8ms로 압축한 것입니다. 이는 인프라 오버헤드가 사실상 'Zero'에 수렴함을 의미하며, 수천 개의 에이전트를 프로덕션에 배포할 때 발생하는 컴퓨팅 리소스 지연(콜드스타트)을 근본적으로 제거합니다.

컴퓨팅 격리 문제가 해결되더라도, 멀티 에이전트 간의 '상태(State)'가 고립된다면 토큰 경제학(Token Economics) 관점에서 심각한 비효율이 발생합니다. Ampere.sh 환경에서 93개의 서브 에이전트를 운영한 한 개발자의 사례는 이를 명확히 보여줍니다. 단일 에이전트가 API Rate Limit이나 IP 블락(Block)에 막혀 실패했을 때, 이를 단순 JSONL 로그로 남기면 다른 92개의 에이전트는 동일한 오류를 범하며 추론 비용(API 토큰)을 낭비하게 됩니다. 이들은 Notion MCP(Model Context Protocol)를 '구조화된 메모리 기질(Memory Substrate)'로 도입하여 이 문제를 해결했습니다. 에이전트의 실패 로그, 토큰 전송 내역, 방어 규칙은 즉시 MCP를 통해 O(1) 조회가 가능한 데이터베이스 테이블로 구조화됩니다.

이 아키텍처가 증명하는 것은 단순한 생산성 향상이 아닙니다. 이는 AgentOps의 핵심인 '결정론적 실패 통제'입니다. 에이전트가 O(n)의 파일 스캐닝을 수행하며 컨텍스트 윈도우를 낭비하는 대신, 구조화된 규칙을 사전 로드하여 불필요한 추론(Prevention Cost $0.00)을 방지합니다. 앞선 에이전트가 지불한 '실패의 토큰 비용'이 MCP를 거쳐 후속 에이전트의 '무료 컨텍스트'로 전이되는 것입니다. 0.8ms의 초저지연 컴퓨팅 샌드박스에서 각 에이전트가 독립적으로 실행되면서도, 이들이 산출하는 지식은 중앙 집중형 구조화 메모리를 통해 실시간 동기화되는 하이브리드 토폴로지가 완성된 셈입니다.

생성형 AI 시스템의 스케일업은 무조건적인 모델 크기 확대나 무지성 프롬프트 체이닝으로 달성되지 않습니다. 진정한 프로덕션 최적화는 Zeroboot처럼 OS 레벨의 메모리 효율성을 극대화하여 P99 지연 시간을 마이크로초 단위로 사수하고, MCP와 같은 표준화된 인터페이스로 멀티 에이전트의 상태(State)와 토큰 비용을 정량적으로 추적·공유하는 구조적 설계에서 비롯됩니다. 향후 대규모 에이전트 프레임워크는 이처럼 인프라 격리 기술과 컨텍스트 라우팅 전략을 긴밀히 결합하는 방향으로 진화할 것이며, 그 중심에는 데이터 중심의 엄밀한 성능 측정이 자리해야 합니다.