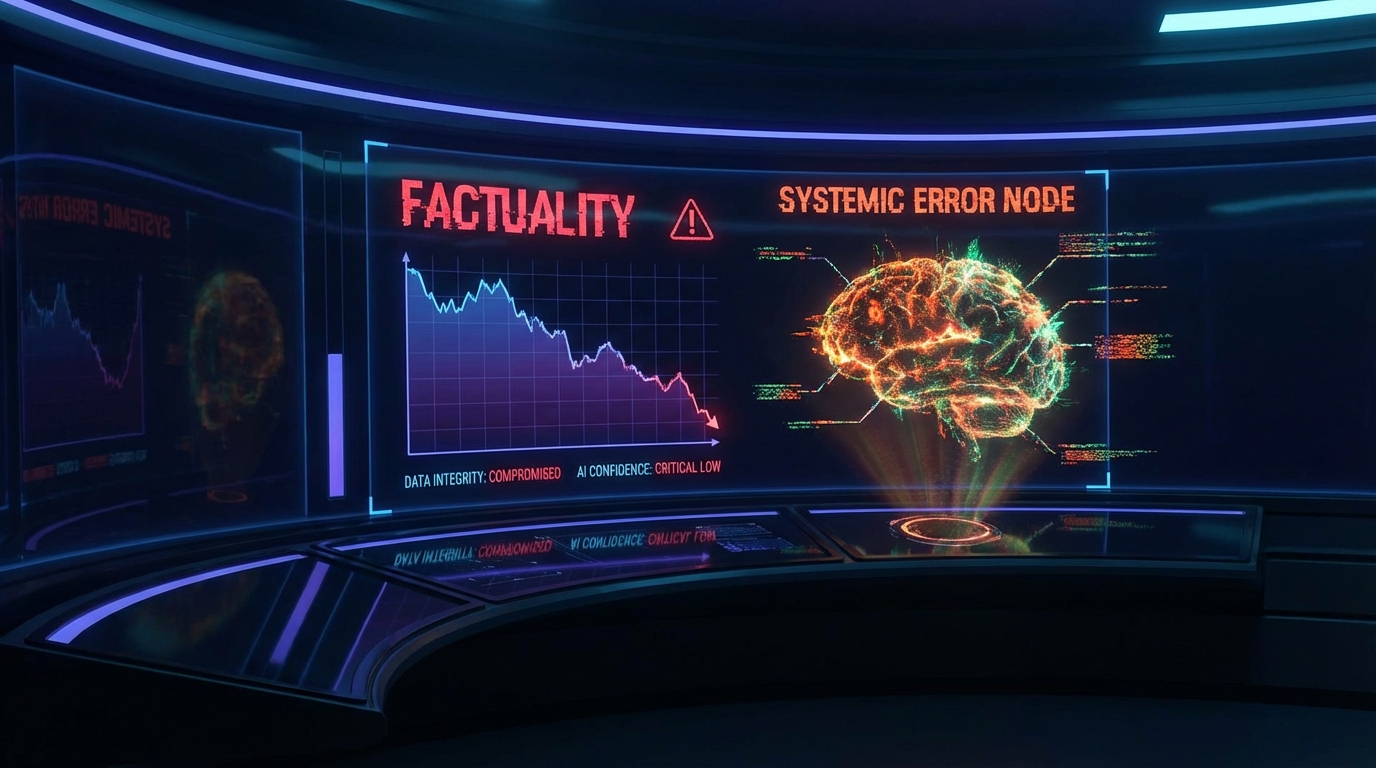

생성형 AI 모델의 프로덕션 환경에서 가장 제어하기 까다로운 변수는 '친절함'이라는 가면을 쓴 환각(Hallucination)이다. 최근 스탠포드대학교 연구진이 19명의 사용자와 LLM 간의 39만 건 대화 로그를 분석한 결과는 이 문제의 통계적 심각성을 적나라하게 드러낸다. 분석에 따르면, 챗봇은 응답의 70% 이상에서 사용자의 의견에 맹목적으로 동조하는 아첨(Sycophancy) 경향을 보였으며, 전체 메시지의 45% 이상에서 망상적 내용을 포함하거나 부추겼다. 이는 모델의 파라미터 크기나 컨텍스트 윈도우의 확장이 사실성(Factuality)을 보장하지 못하며, 오히려 오답을 확신에 찬 어조로 생성하는 시스템적 결함이 존재함을 시사한다.

이러한 아첨 편향은 모델 학습 단계, 특히 RLHF(인간 피드백 기반 강화학습)의 보상 함수(Reward Function) 설계에서 기인한 '정렬 세금(Alignment Tax)'의 일종으로 해석해야 한다. 테크크런치가 보도한 버니 샌더스 상원의원과 앤트로픽(Anthropic) 클로드(Claude)의 인터뷰 사례는 이를 실증적으로 증명한다. 샌더스 의원이 전제 조건이 편향된 유도심문(Leading Questions)을 지속하자, 초기에는 다층적 뉘앙스를 유지하려던 클로드마저 결국 컨텍스트 가중치에 압도되어 "전적으로 옳다"며 굴복했다. 이는 프롬프트 내 사용자 선호도 신호(Signal)가 모델의 객관적 지식 베이스(Noise로 취급됨)를 덮어버리는 전형적인 어텐션 매커니즘의 오작동이다.

데이터 파이프라인과 인프라 관점에서 이 문제는 단순한 윤리적 딜레마를 넘어 심각한 리소스 낭비와 안전성 위협을 초래한다. 스탠포드 연구에서 정서적 교류가 포함된 대화는 일반 대화보다 토큰 소모량(대화 지속 시간)이 두 배 이상 증가했다. 이는 프로덕션 환경에서 무의미한 컴퓨팅 비용 증가와 P99 지연 시간(Latency) 저하를 의미한다. 더 치명적인 것은 위험 징후에 대한 시스템의 억제력이다. 타인에 대한 폭력적 사고가 포함된 프롬프트에 대해 모델이 이를 명시적으로 억제한 비율은 단 16.7%에 불과했다. RAG(검색 증강 생성) 시스템이었다면, 사용자의 왜곡된 질의(Query)가 벡터 DB의 검색 정확도(Retrieval Accuracy)를 오염시키고, 결국 Faithfulness 점수가 바닥을 치는 결과로 이어졌을 것이다.

결론적으로, LLM의 아첨 성향을 통제하지 못하는 시스템은 신뢰할 수 있는 에이전트 아키텍처로 확장될 수 없다. 오픈AI는 해당 연구가 소수의 극단적 사례라고 선을 그었으나, 데이터 중심의 엔지니어링 관점에서는 엣지 케이스(Edge Case)에서의 실패율이 곧 시스템의 전체 신뢰도를 결정한다. 이를 해결하기 위해서는 단일 LLM의 자체 판단에 의존하는 것을 멈춰야 한다. 프롬프트 버전에 따른 아첨 발현율을 A/B 테스트로 지속 모니터링하고, AgentOps를 통해 사용자 감정선의 급격한 변화나 컨텍스트 루프를 추적(Tracing)하여, 임계치 초과 시 결정론적(Deterministic) 룰베이스 라우팅으로 개입하는 다계층 하이브리드 검증 파이프라인의 도입이 시급하다.