생성형 AI 모델을 프로덕션 환경에 배포한 직후에는 95%의 정확도와 100ms 미만의 추론 지연 시간(Latency)을 기록하며 완벽해 보일 수 있다. 하지만 6개월 뒤, 지연 시간이 500ms로 점진적으로 악화되는 현상이 빈번하게 관찰된다. 최근 개발자 커뮤니티(dev.to)에서 '조용한 AI 세금(Silent AI Tax)'이라고 명명한 이 현상은, 모델의 예측 정확도는 유지되지만 인프라 리소스 소모량과 P99(하위 1%) 지연 시간이 복리로 증가하는 시스템적 병목을 의미한다. 데이터 중심의 분석 관점에서 볼 때, 프롬프트 엔지니어링이나 RAG의 검색 정확도 개선 이전에 서빙 인프라의 성능 저하를 방어하는 것이 최우선 과제다.

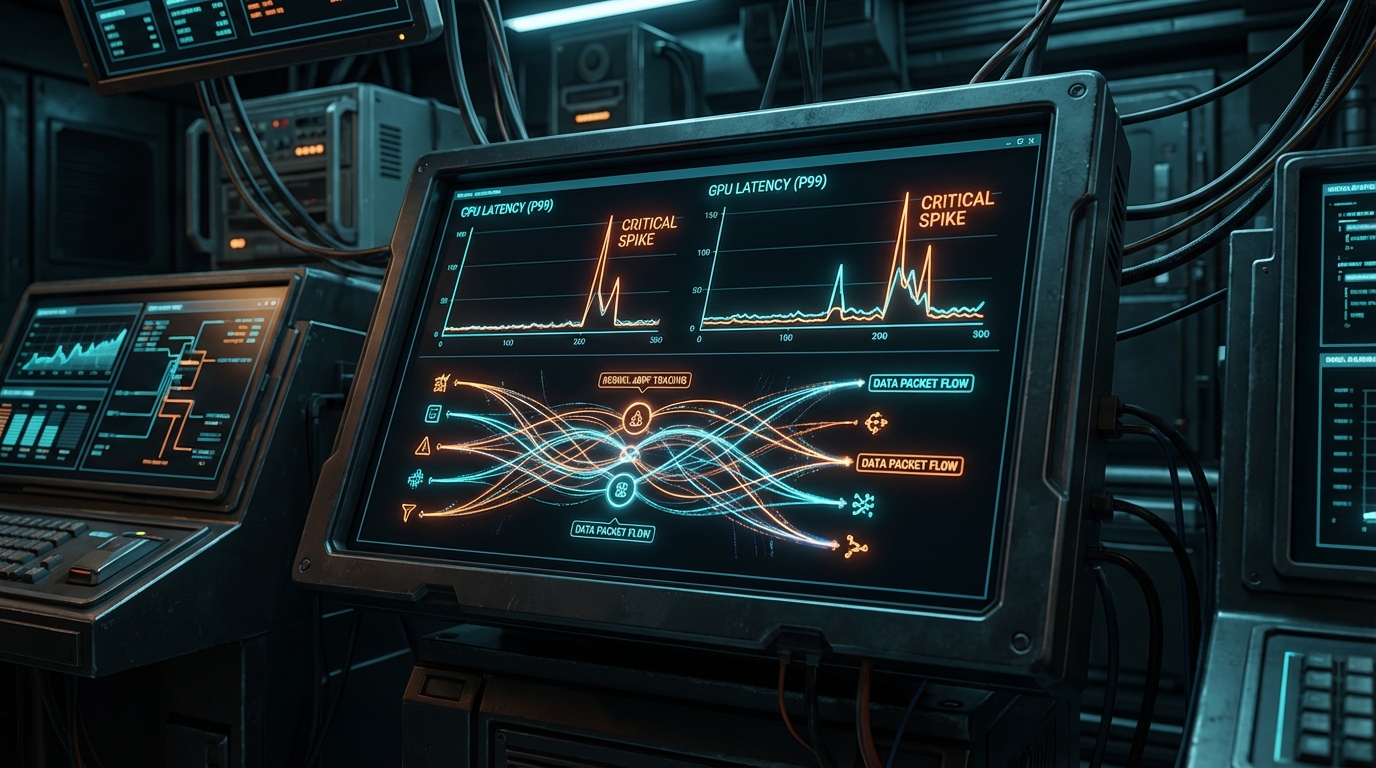

이러한 'AI Tax'가 극단적으로 발현되는 지점은 동시 다발적인 추론 요청이 몰리는 vLLM 서빙 환경이다. dev.to에 공유된 eBPF 기반 vLLM 디버깅 사례는 P99 지연 시간 스파이크의 실체를 정량적으로 보여준다. 특정 환경에서 n_completions=8과 logprobs=20 파라미터가 결합되었을 때, vLLM에 스케줄링된 다른 모든 요청이 9~11초 동안 블로킹되는 심각한 장애가 발생했다. 커널 레벨에서 10,869개의 이벤트를 추출해 인과 사슬(Causal chains)을 분석한 결과, cudaLaunchKernel의 P50(중간값) 지연 시간은 16.7µs에 불과했으나, P99 지연 시간은 무려 784배 폭증한 13.1ms를 기록했다.

흥미로운 점은 이 병목의 근본 원인(Root cause)이 GPU 연산 성능이나 VRAM 부족이 아니었다는 사실이다. 오픈 웨이트(Open-weight) 모델인 MiniMax M2.7과 MCP(Model Context Protocol)를 결합해 자율 분석을 수행한 결과, CPU 스케줄링 경합이 범인으로 지목되었다. vLLM 엔진 코루틴이 다른 프로세스에 의해 5,347회나 컨텍스트 스위칭(Context-switched)되면서 총 18.4초의 CPU 가용성 손실을 유발했고, 이로 인해 GPU는 연산을 수행하지 못한 채 대기 상태로 방치되었던 것이다. 이는 GPU 사용량 지표만 모니터링해서는 절대 잡아낼 수 없는, OS 레벨의 스케줄링 병목이다.

이러한 구조적 지연을 방어하기 위해서는 추론 환경을 철저히 격리하고 성능을 정량화하는 모니터링 파이프라인이 필수적이다. 첫째, Prometheus와 같은 도구를 활용해 애플리케이션 레벨에서 P50, P95, P99 지연 시간을 마이크로초 단위로 추적해야 한다. 둘째, CI/CD 파이프라인에 성능 벤치마크를 통합하여 "P99 지연 시간이 150ms를 초과할 경우 배포를 차단(Fail)"하는 결정론적 제약을 걸어야 한다. 셋째, PyTorch의 TorchScript나 TensorRT를 활용한 모델 컴파일 최적화와 함께, Docker의 cgroups를 통한 프로세스 및 리소스 격리(Process Isolation)를 강제하여 CPU 컨텍스트 스위칭으로 인한 노이즈를 차단해야 한다.

생성형 AI 시스템에서 성능은 곧 기능(Feature)이자 비용이다. 아무리 높은 BLEU 점수와 완벽한 RAG Context Precision을 달성하더라도, 프로덕션 환경의 P99 지연 시간이 수 초 단위로 튀어버린다면 사용자 경험은 파괴되고 GPU 토큰 효율성은 급감한다. 값비싼 클로즈드 소스 API에 의존하지 않고 eBPF와 오픈 모델 기반의 MCP 조합만으로도 커널 단위의 병목을 진단할 수 있다는 점은 시사하는 바가 크다. AI 엔지니어는 이제 모델의 정확도뿐만 아니라, 서빙 과정에서 누수되는 1밀리초의 'AI Tax'까지 데이터로 입증하고 최적화하는 시스템 아키텍트로 진화해야 한다.