프로덕션 RAG(Retrieval-Augmented Generation) 시스템의 가장 큰 착각은 임베딩 기반의 코사인 유사도(Cosine Similarity) 검색이 결과의 사실성(Factuality)을 보장한다고 믿는 것이다. 최근 Dev.to에 게재된 임베딩 분석 기사가 지적하듯, 대부분의 상용 벡터 DB는 사전 학습된 모델의 특성상 벡터의 크기(Magnitude)를 무시하고 방향성만을 평가하는 코사인 유사도에 의존한다. 그러나 고차원 벡터 공간에서 단순히 거리가 가깝다는 것은 '의미적 유사성'을 뜻할 뿐, LLM이 해당 문맥을 기반으로 '정확한 답변'을 도출할 수 있는 상태인지는 전혀 대변하지 못한다. 이는 OOD(Out-of-Distribution) 쿼리 입력 시 RAG 시스템이 자신 있게 환각(Hallucination)을 내뱉는 구조적 병목이 된다.

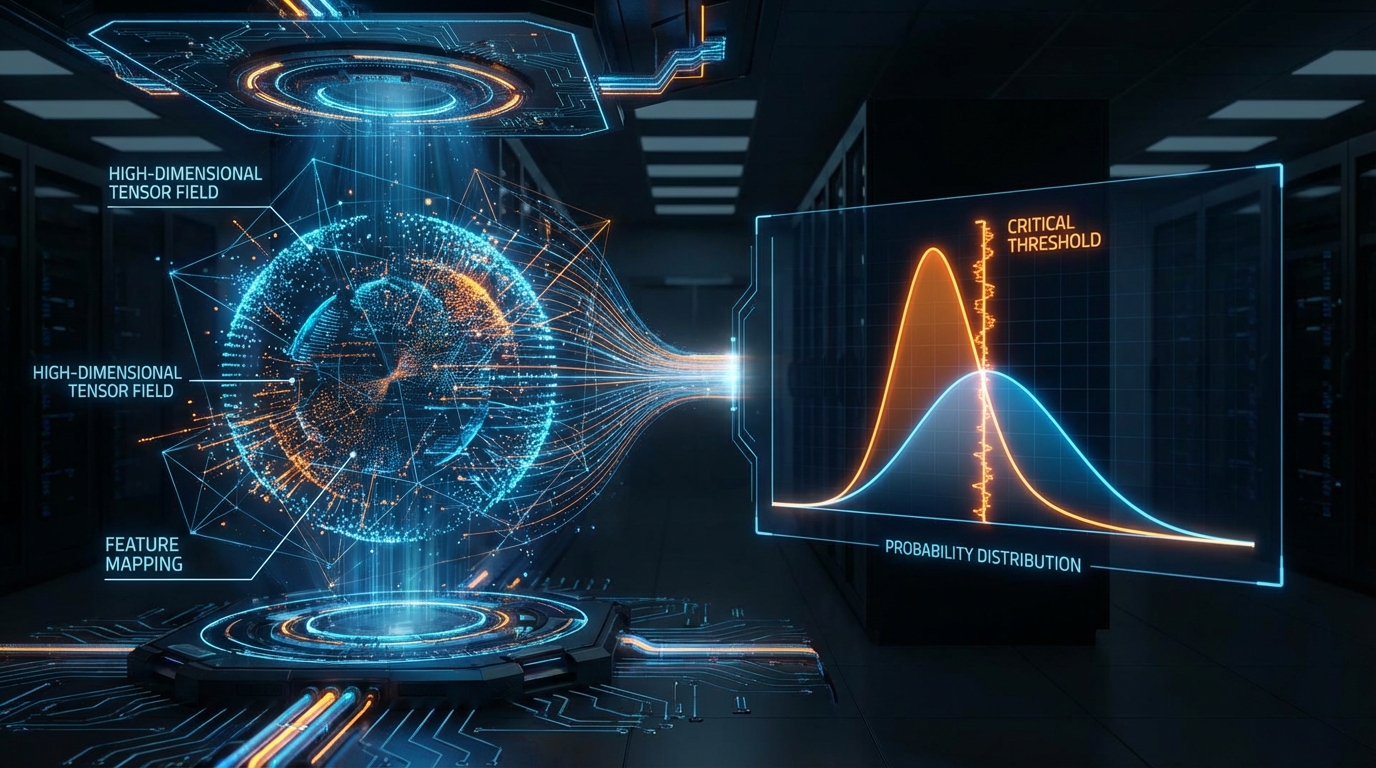

이 문제를 해결하기 위한 실증적 돌파구는 트랜스포머(Transformer) 아키텍처를 베이지안 네트워크(Bayesian Networks)로 해석하는 데서 찾을 수 있다. 또 다른 Dev.to의 최신 기술 논의에 따르면, 트랜스포머의 어텐션 메커니즘은 본질적으로 조건부 확률 의존성을 학습한다. 이는 생성형 모델을 단순한 블랙박스 API(예: model.generate(prompt))로 취급하는 관행에서 벗어나, 소프트맥스(Softmax)를 통과한 로짓(Logits) 데이터로부터 모델의 불확실성(Uncertainty)을 정량적으로 추출할 수 있음을 시사한다. 즉, 출력 토큰의 확률 분포에 대한 엔트로피를 계산하여, 그 값이 높을수록 모델이 내부적으로 혼란을 겪고 있다는 통계적 증거를 확보하는 것이다.

이러한 베이지안 접근법은 RAG 시스템의 신뢰도 평가 파이프라인을 완전히 재설계하게 만든다. 지금까지는 프롬프트 엔지니어링을 통해 "모르면 모른다고 답하라"는 식의 휴리스틱(Heuristics)에 의존했다면, 이제는 생성 과정에서 실시간으로 엔트로피 임계값(Threshold)을 모니터링할 수 있다. 예를 들어, Retrieval 단계에서 검색된 컨텍스트의 정밀도(Context Precision)가 낮아 LLM의 토큰 생성 엔트로피가 급증할 경우, 시스템은 즉각 출력을 중단하고 추가 검색 에이전트를 라우팅하거나 사용자에게 Clarification을 요청할 수 있다. 이는 무의미한 토큰 낭비를 막아 컴퓨팅 비용을 최적화하고, Faithfulness 평가 지표를 독립적으로 제어하는 강력한 아키텍처적 기반이 된다.

결론적으로, 생성형 AI의 다음 최적화 과제는 '얼마나 답변을 잘 만들어내는가'가 아니라 '스스로의 불확실성을 얼마나 정밀하게 측정하는가'로 이동하고 있다. 모델 추론 시 로짓을 반환받아 불확실성을 계산하는 오버헤드는 존재하지만, 환각으로 인한 치명적 오류 비용과 P99 지연 시간(Latency) 페널티를 고려하면 이는 프로덕션 환경에서 충분히 수용 가능한 트레이드오프다. ML 엔지니어들은 이제 코사인 유사도라는 단일 검색 지표에 의존하는 것을 넘어, 베이지안 확률 모델을 통한 생성 신뢰도 정량화를 시스템 서빙의 기본 안전장치(Guardrail)로 도입해야 할 시점이다.