LLM 프로덕션 서빙에서 P99 지연 시간(Latency)이 튀는 근본 원인은 연산량(FLOPs) 부족이 아니다. 컨텍스트 길이가 길어질수록 선형적으로 팽창하는 KV(Key-Value) 캐시가 HBM(High-Bandwidth Memory) 대역폭을 포화시키는 I/O 병목이 진짜 원인이다. 최근 발표된 두 가지 기술적 성과는 이 병목을 해결하기 위한 알고리즘과 인프라 차원의 극단적 접근을 보여준다. dev.to에 공개된 Google의 'TurboQuant' 알고리즘과 NVIDIA의 'Dynamo' 오케스트레이션 프레임워크는 각각 '데이터의 물리적 크기 축소'와 '연산 파이프라인의 분리'를 통해 비용-성능 트레이드오프의 새로운 기준점을 제시했다.

먼저 알고리즘 측면에서, Google의 TurboQuant는 단순한 가중치(Weight) 양자화를 넘어 동적 데이터인 KV 캐시에 메타데이터 오버헤드 없이 3-bit PTQ(Post-Training Quantization)를 적용했다. 핵심은 기하학적 구조를 활용한 2단계 압축이다. PolarQuant가 고에너지 신호를 극좌표계로 변환해 압축하고, QJL(Quantized Johnson-Lindenstrauss)이 1-bit로 잔여 오차를 보정한다. 실험 데이터에 따르면 이 구조는 정확도 손실 없이 KV 캐시 메모리 사용량을 6배 감소시키며, NVIDIA H100 GPU 기준 Attention Scoring 속도를 최대 8배 향상시킨다. 이는 물리적 메모리 Fetch 요청 횟수를 줄여 디코딩 단계의 지연 시간을 직접적으로 타격한 통계적으로 유의미한 결과다.

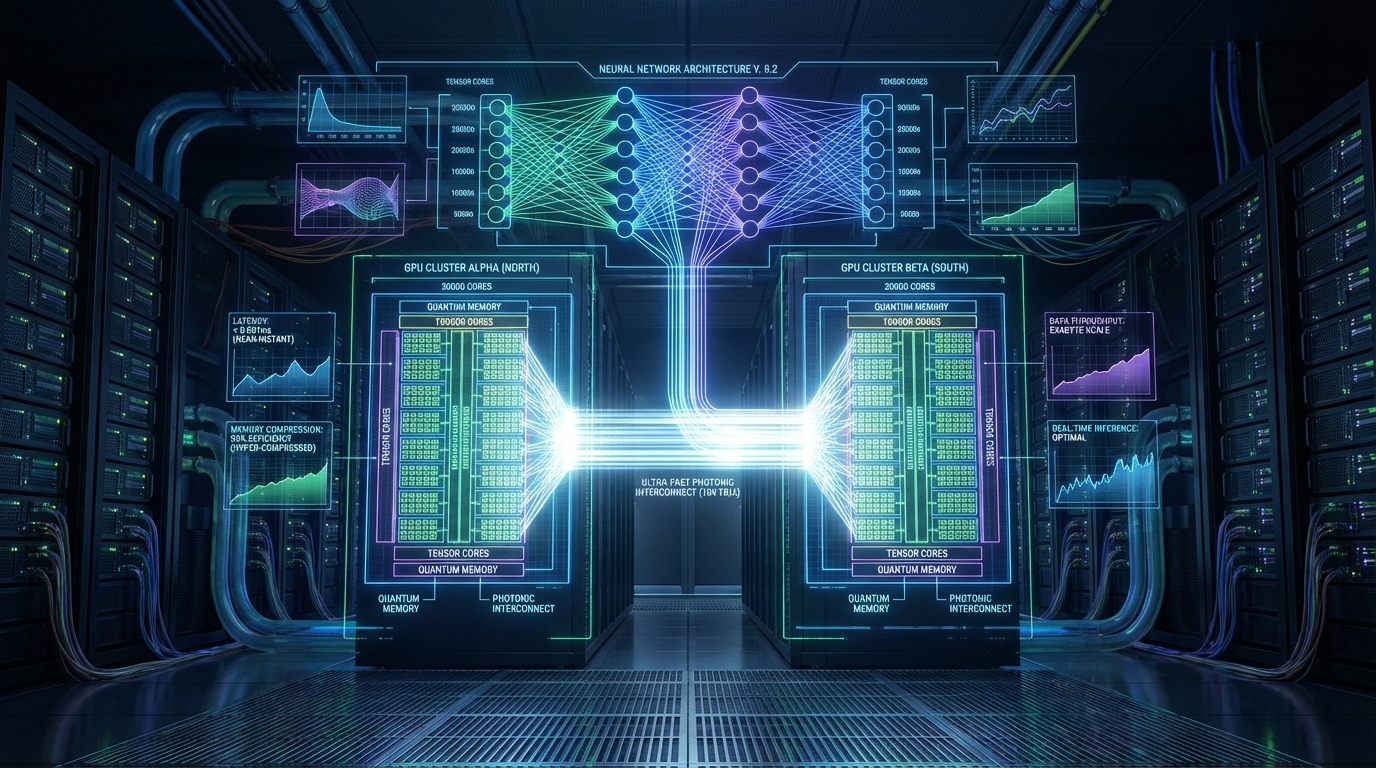

반면, 인프라스트럭처 측면에서 NVIDIA Dynamo는 단일 GPU 내부에서 처리되던 추론 구조를 해체(Disaggregation)했다. Compute-bound 특성을 가진 Prefill(입력 처리) 단계와 Memory-bandwidth-bound 특성을 가진 Decode(토큰 생성) 단계를 서로 다른 GPU 풀로 분리한 것이다. 여기서 발생하는 노드 간 KV 캐시 전송 지연은 RDMA 기반의 NIXL 라이브러리를 통해 Zero-copy로 해결했다. 단, 시스템 평가 관점에서 이 아키텍처가 모든 환경에 유효한 것은 아니다. 오케스트레이션 오버헤드를 정량적으로 고려할 때, 8대 이상의 멀티 노드 환경과 동시성(Concurrency)이 극도로 높은 프로덕션에서만 ROI가 성립하는 전형적인 규모의 경제 최적화 모델이다. 단일 노드에서는 여전히 vLLM이나 SGLang이 우위를 점한다.

이 두 기술의 교차점을 해석하면 향후 LLM 서빙의 단위 토큰당 처리 비용을 결정하는 핵심 변수를 도출할 수 있다. TurboQuant로 압축된 초소형 KV 캐시 페이로드를 Dynamo의 NIXL 네트워크를 통해 마이크로초 단위로 분리된 노드 간에 라우팅하는 하이브리드 아키텍처가 구성될 경우, 기존 서빙 대비 처리량(Throughput)은 비약적으로 증가할 것이다. 그러나 이는 동시에 벤더 종속성(Vendor Lock-in)의 함정을 내포한다. 알고리즘 레벨의 압축을 오픈소스로 풀어버린 Google의 행보와, 오케스트레이션을 오픈소스화하여 자사의 네트워크 장비와 GPU 클러스터로 물리적 하드웨어 종속을 유도하는 NVIDIA의 전략적 비대칭성을 시스템 아키텍트는 비판적이고 데이터 중심적인 시각으로 평가해야 한다.