오픈AI가 영상 생성 서비스 Sora를 종료한다는 소식(비즈월드)은 ‘기술 데모는 환호를 만들지만, COGS는 생존을 결정한다’는 신호에 가깝다. 소비자용 영상 생성은 사용자가 기대하는 품질·길이·반복 생성 횟수가 높아질수록 추론 비용이 기하급수로 올라간다. 이때 제품의 문제는 모델이 아니라, 무료/저가로는 못 버티고 고가로는 전환이 안 되는 가격-가치 곡선의 붕괴다.

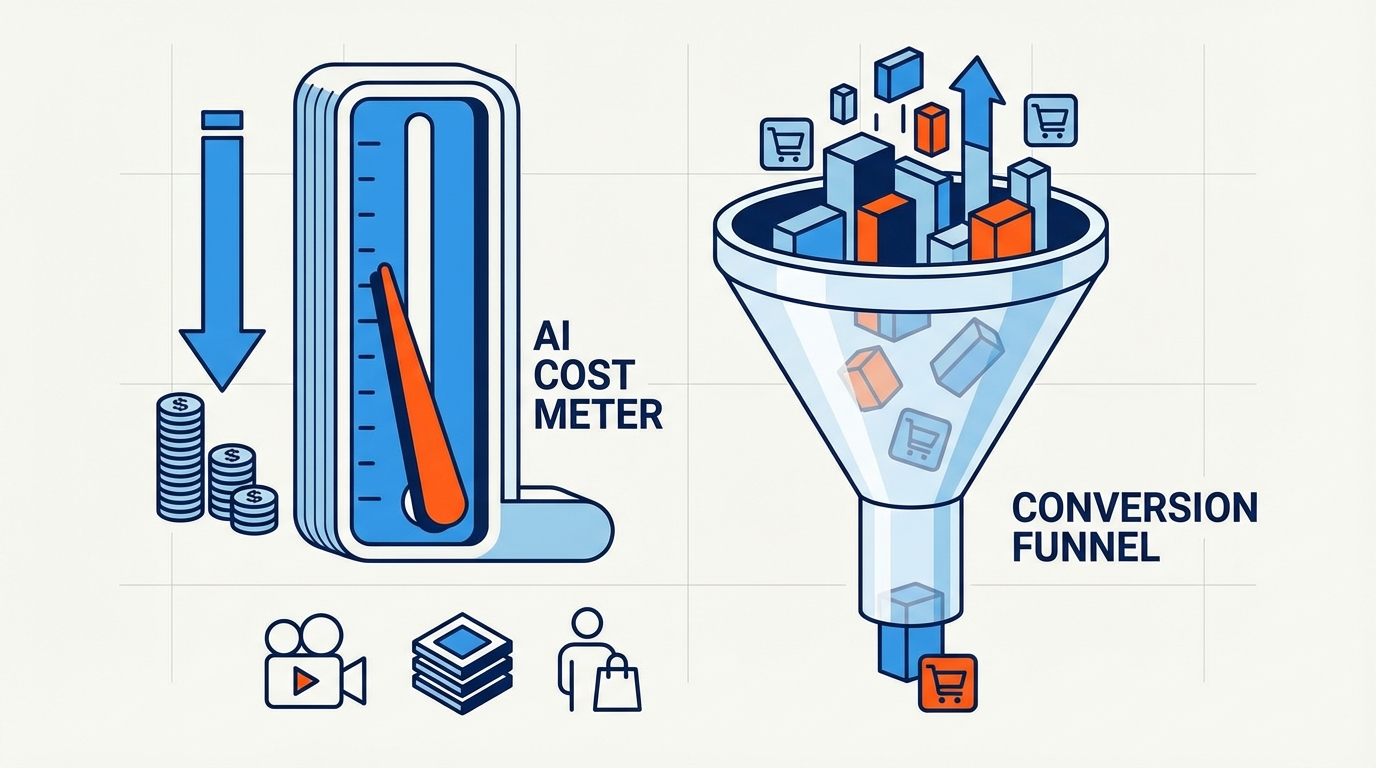

이 이슈를 ‘전략 전환’으로만 읽으면 반쪽짜리다. Sora 같은 고비용 소비자 서비스는 결국 AARRR 퍼널에서 Activation과 Revenue 사이가 끊어진다. 체험은 강하지만(와우 모먼트), 결제 장벽에서 급격히 떨어진다. 게다가 생성 실패/대기시간/재시도는 퍼널 마찰을 더 키워 CAC를 악화시킨다. 즉, 서빙 비용이 높으면 가격을 올리거나 사용량을 막아야 하고, 그 순간 전환율이 무너진다.

반대로 같은 모델이라도 ‘운영 단가’를 바꾸면 퍼널이 다시 열린다. 구글이 공개한 TurboQuant(AI타임즈)는 LLM 추론의 병목인 KV 캐시 메모리를 대폭 압축해(최소 6배 절감, 환경에 따라 H100에서 속도 최대 8배 개선) 동일한 경험을 더 싸게 제공할 수 있게 한다. 이건 단순 최적화가 아니라 성장 레버리지다. ① 동일 예산에서 더 많은 세션을 서빙해 트래픽 상한을 올리고, ② 더 긴 문맥/더 빠른 응답으로 체감 품질을 올리며, ③ 무엇보다 ‘과금 전환을 유도할 수 있는 가격대’로 내려올 수 있다. CAC/LTV 관점에서 보면 COGS 절감은 곧 LTV 개선(마진 확대)이고, 그 마진이 다시 집행 가능한 CAC를 넓힌다.

여기서 중요한 건 “비용 절감 = 이익”이 아니라 “비용 절감 = 전환 설계의 자유도”라는 점이다. 예를 들어, COGS가 내려가면 (1) 온보딩 구간에서 더 공격적인 무료 크레딧을 제공해 Activation을 끌어올릴 수 있고, (2) 유료 전환 직전에 고비용 기능(장문/고해상도/에이전트 실행)을 ‘맛보기’로 보여줄 수 있으며, (3) 리텐션을 만드는 반복 사용(저장, 재생성, 히스토리 기반 추천)을 제한 없이 풀 수 있다. 결국 COGS는 퍼널의 스로틀(Throttle) 이다.

현대백화점 AI 쇼핑 어시스턴트 ‘헤이디’가 선물하기에서 구매 전환율 28%를 기록했다는 사례(네이트/디지털데일리)는 이 논리를 매출로 증명한다. 흥미로운 포인트는 ‘더 큰 모델’이 아니라, RAG 기반으로 빠르게 출시하고 검색 정밀도 1~2%를 집요하게 올리며, 상품 메타를 AI 인리치먼트로 보강해 추천 품질을 끌어올렸다는 운영 전략이다. 즉 COGS를 폭발시키는 자체 SLM 학습 대신, 시장 반응을 빨리 받아 퍼널을 다듬는 쪽을 선택했다. 전환율 28%라는 숫자는 “AI 기능이 붙었다”가 아니라 “퍼널 한가운데를 AI가 대체했다”는 뜻이다.

시사점은 명확하다. 이제 AI 제품의 그로스는 ‘모델 성능’이 아니라 (1) COGS를 얼마나 낮추는가(인프라/메모리/캐시/라우팅), (2) 그 절감분을 전환율 개선에 어떻게 재투자하는가(온보딩·가격·제한·경험), (3) 전환에 직결되는 업무/구매/상담 흐름을 얼마나 깊게 먹는가로 갈린다. Sora 종료가 보여준 건 고비용 소비자 AI의 취약함이고, TurboQuant가 열어주는 건 같은 경험을 더 싸게 서빙하는 인프라 우위다. 헤이디는 그 우위를 ‘추천→구매’라는 퍼널에 꽂아 넣었을 때 어떤 숫자가 나오는지 보여준다.

전망적으로 AI 시장은 ‘모델의 시대’에서 ‘단가의 시대’로 이동한다. 단가가 내려가면 무료 체험은 더 길어지고, 전환 실험은 더 촘촘해지며, 결국 승자는 가장 싼 모델이 아니라 가장 싼 전환을 만드는 팀이 된다. 다음 분기 실행 우선순위는 간단하다: ① 우리 서비스의 토큰/메모리/대기시간을 기능별로 분해해 COGS를 계측하고, ② COGS 상위 20% 기능에 TurboQuant류 압축/캐시 전략/모델 라우팅을 적용해 단가를 깎고, ③ 그 절감분으로 Activation 구간의 무료 ‘첫 성공’을 늘려 전환율을 재측정하라. AI COGS를 낮추는 팀이, 전환을 더 싸게 산다.