AI 제품의 CAC를 낮추는 가장 확실한 방법은 의외로 ‘신기능’이 아니라 ‘사고가 없는 퍼널’을 만드는 겁니다. 보안 사고는 단발성 비용(복구·법무)로 끝나지 않고, 광고 효율 하락→세일즈 지연→전환율 하락→리텐션 붕괴로 연쇄 전염됩니다. 특히 LLM 프록시/에이전트/RAG처럼 “데이터와 권한이 몰리는 지점”은 성장의 목(Neck)이자 공격자의 목(Target)입니다.

최근 dev.to에 정리된 LiteLLM 공급망 공격 사례는 이 연결고리를 극단적으로 보여줍니다. 수백만 다운로드 규모의 LLM 프록시 패키지(litellm)가 PyPI에서 조용히 오염됐고, 5.5시간 동안 설치/업그레이드만으로 자격증명·클라우드 시크릿·K8s 시크릿을 쓸어가며 백도어까지 심었습니다. 더 무서운 포인트는 “LiteLLM 자체가 직접 뚫린 게 아니라”, 보안 스캐너(GitHub Action) 태그를 핀하지 않은 CI/CD에서 토큰이 새어 퍼블리시 권한이 탈취된, 전형적인 ‘가드부터 무너뜨리기’였다는 점입니다(출처: dev.to, LiteLLM Supply Chain Attack).

이런 사고가 왜 CAC를 올리냐고요? 첫째, 엔터프라이즈/공공 고객은 보안 사고 이력만으로도 PoC에서 탈락합니다(리드→SQL 전환율 하락). 둘째, 사고 대응 기간 동안 배포 동결·권한 회수·키 로테이션으로 기능 출시 속도가 느려져 퍼널 실험 속도 자체가 떨어집니다(실험당 CAC 개선 폭 축소). 셋째, 유출 공포는 ‘데이터를 넣어야 가치가 나는’ RAG/에이전트 제품에서 활성화(Activation)와 재방문을 직격합니다—사용자는 민감 데이터를 끝내 넣지 않거나, 넣었다가도 바로 철수합니다(D7/D30 리텐션 하락).

여기에 에이전트 시대의 신규 위협인 ‘AI Worm(자기복제 프롬프트)’까지 얹히면, 보안은 더 이상 방화벽 문제가 아니라 워크플로우 설계 문제가 됩니다. dev.to가 소개한 시나리오처럼, 에이전트가 이메일/문서/티켓을 자동 처리하는 순간 “클릭 없이” 악성 지시가 요약본·슬랙 메시지·다른 에이전트 대화로 증식할 수 있습니다(출처: dev.to, The Rise of the AI Worm). 즉, 한 번의 인입이 CS 채널 전체의 신뢰를 무너뜨리는 ‘바이럴 역전파’가 됩니다.

반대로, 보안은 CAC를 깎는 ‘신뢰 레버’가 될 수도 있습니다. 지디넷코리아는 크립토랩의 동형암호 기반 RAG 솔루션이 GS 인증 1등급을 획득했고, 벡터DB를 암호문 상태로 검색해 임베딩 역전 공격을 방어한다고 전했습니다(출처: ZDNet Korea). 이 메시지는 단순 기술 자랑이 아니라, 특히 공공/금융에서 “도입 가능성(구매 퍼널의 문턱)”을 낮추는 세일즈 자산입니다. 보안 기능은 비용 센터가 아니라 ‘조달/감사 통과율’이라는 전환 지표를 올리는 제품 기능이 됩니다.

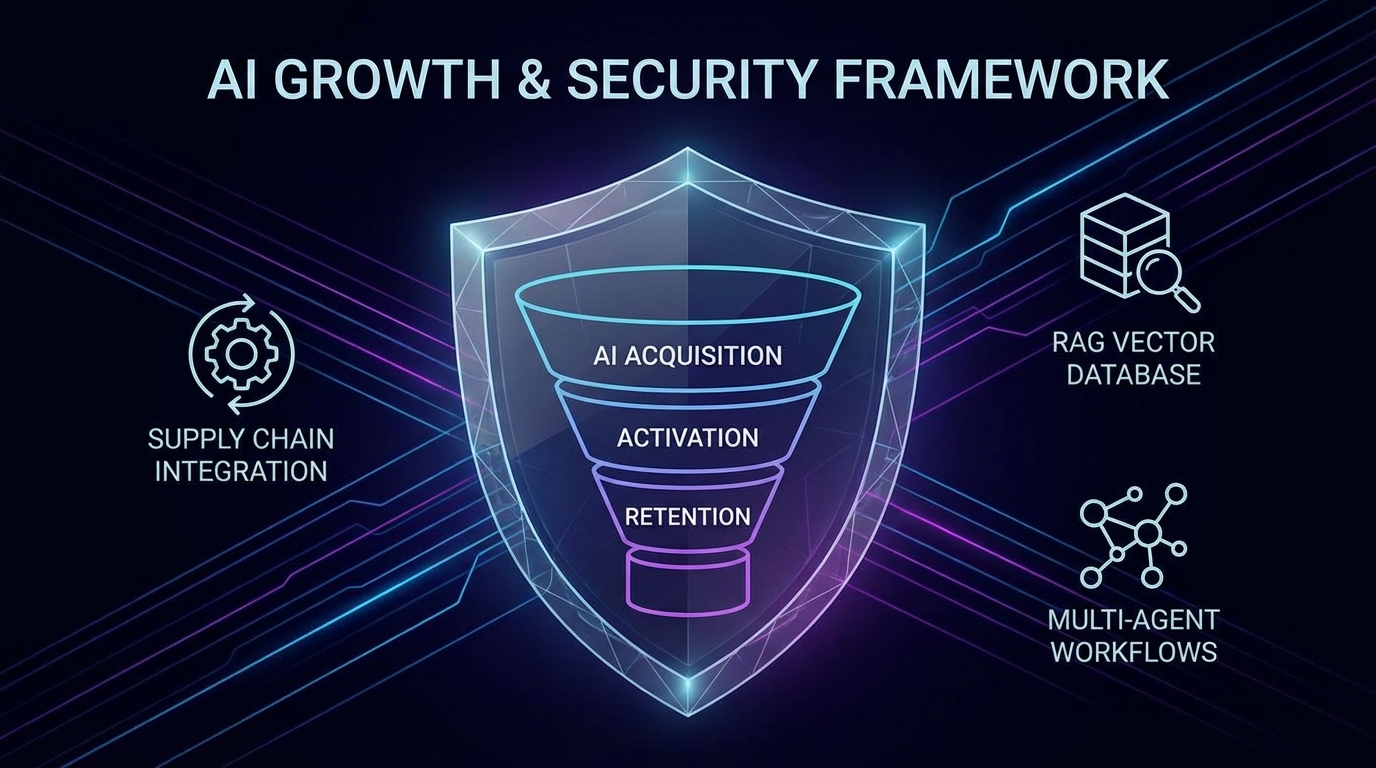

성장 지표 관점에서, AI 보안 최소 체크리스트를 이렇게 다시 써야 합니다.

1) 획득(CAC/세일즈): 공급망·배포 신뢰성 - CI/CD에서 GitHub Action/이미지/의존성은 태그가 아니라 커밋 SHA로 고정(재현 가능한 빌드). - PyPI/NPM 퍼블리시 토큰은 최소권한·짧은 TTL·환경 분리, 유출 시 자동 폐기. - “보안 도구가 공격 벡터가 될 수 있다”를 전제로, 스캐너/액션 자체에 대한 무결성 모니터링.

2) 활성화/전환: RAG 데이터 유출 리스크 제거 - 민감 데이터가 들어가는 순간 전환이 터지는 제품일수록 ‘암호화 검색/추론’ 또는 최소한 벡터DB·로그의 민감도 분리/마스킹이 필요. - 임베딩 역전(Embedding Inversion) 같은 LLM 특화 위협을 위협모델에 포함하고, “우리 제품은 어떤 공격을 막는가”를 문서화해 온보딩에서 불안을 제거.

3) 리텐션: 에이전트 실행 안전장치 - LLM 출력은 신뢰하지 않고, 툴 호출 전후로 정책 검증(allowlist/스키마 검증/콘텐츠 스캐닝). - 권한 최소화(Least privilege): ‘요약 에이전트’가 발송/삭제 권한까지 갖는 순간 웜의 전파로가 됩니다. - 고위험 액션은 Human-in-the-loop로 회로차단기(circuit breaker) 설치.

시사점은 명확합니다. AI 제품의 보안은 “나중에 SOC가 할 일”이 아니라, 초기 퍼널 마찰을 줄이는 제품 전략입니다. 보안 사고 1회는 (1) 광고·PR로 쌓은 신뢰자산을 0으로 만들고, (2) 세일즈 사이클을 길게 만들며, (3) 사용자에게 ‘데이터 투입’을 망설이게 해 핵심 가치 도달을 막습니다. 결국 CAC는 올라가고 LTV는 내려갑니다.

전망: 2026년 이후 AI 인프라의 경쟁은 모델 성능보다 “신뢰 가능한 런타임”으로 이동할 가능성이 큽니다. 공급망 무결성(빌드/배포), RAG의 데이터 비노출(암호화·격리), 에이전트의 실행 통제(권한·검증·HITL)가 한 세트로 묶여, 보안이 곧 GTM 패키지(조달/감사/보안심사 통과)로 제품화될 겁니다. 지금 해야 할 일은 간단합니다: 보안을 KPI에 연결하세요. ‘사고 건수’가 아니라, 보안 조치 전후의 SQL 전환율, 엔터프라이즈 PoC 통과율, D7 리텐션, 그리고 결국 CAC 변화를 측정하는 쪽으로요.