"데이터 프라이버시를 위해 로컬을 쓴다"거나 "만능인 API를 쓴다"는 이분법은 2026년 현재 아키텍처 설계의 지적 나태(Intellectual laziness)를 의미한다. Dev.to에 공개된 최신 벤치마크와 국내 브런치 아티클의 분석을 종합하면, 로컬 LLM의 실효성은 맹목적인 감(Gut feeling)이 아닌 하드웨어의 VRAM 한계와 토큰 처리 지연 시간(Latency)이라는 엄밀한 정량적 지표 위에서 평가되어야 한다. 우리는 이제 비용-성능의 미세한 트레이드오프를 수치로 정밀하게 쪼개어 판단하는 데이터 중심의 의사결정 프레임워크가 필요하다.

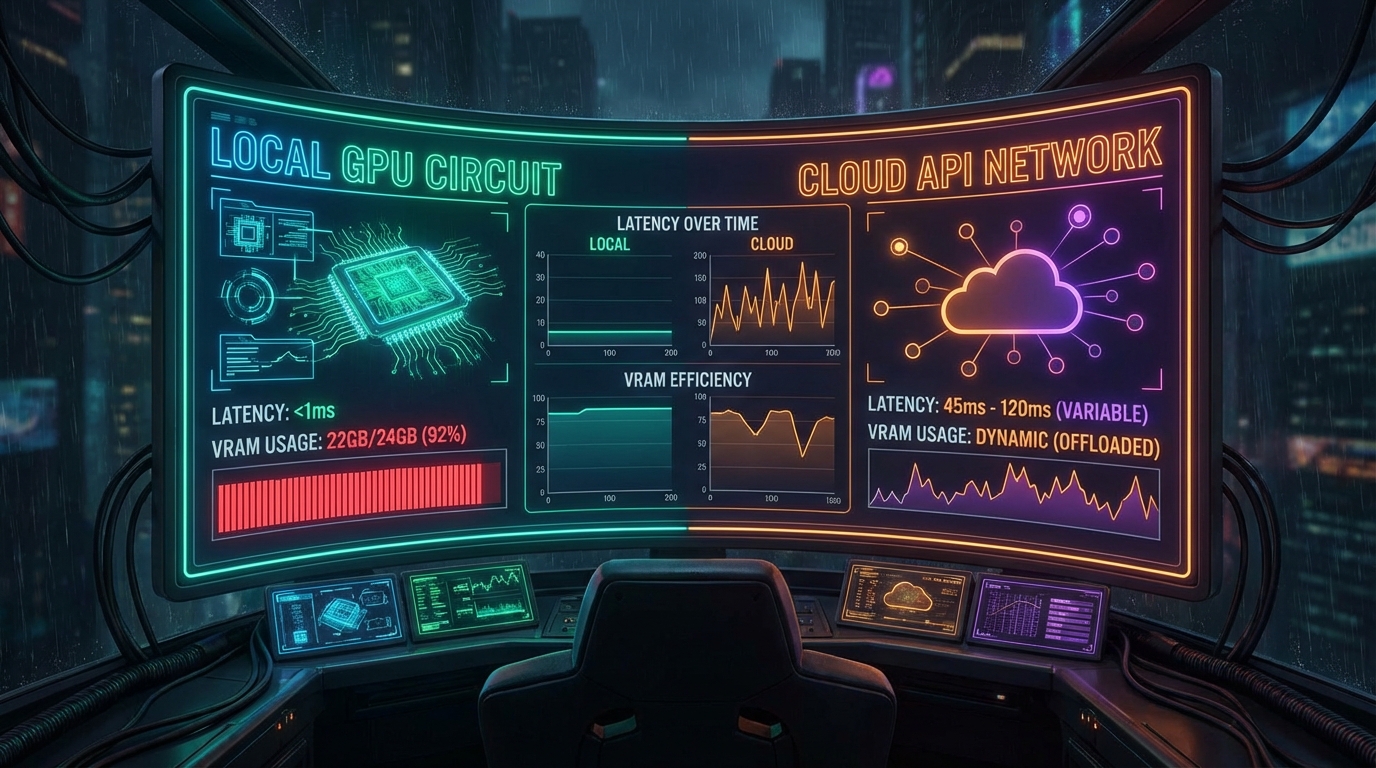

가장 핵심적인 평가 지표는 VRAM 제약에 따른 토큰 생성 속도(tok/s)와 첫 토큰 도달 시간(TTFT)의 역학 관계다. 벤치마크에 따르면, 8GB VRAM을 장착한 RTX 4060에서 양자화된(Q4_K_M) Qwen2.5-7B 모델은 68 tok/s와 약 50ms의 압도적으로 낮은 TTFT를 기록했다. 반면 16GB 통합 메모리를 갖춘 M4 Mac mini는 14B 모델을 44 tok/s로 구동하지만 32B 모델에서는 심각한 메모리 병목을 일으킨다. 흥미로운 점은 지연 시간의 통계적 분포다. 로컬 환경은 TTFT의 분산(Variance)이 극도로 적어 실시간 UX에 유리하지만 처리량(Throughput)의 물리적 상한선이 명확하다. 반대로 Gemini 2.0 Flash나 Claude 3.5 Haiku 같은 최신 API는 TTFT가 200~600ms로 높지만, 병렬 요청 시 인프라 제약 없이 확장이 가능하다. 즉, '단순 속도' 비교는 무의미하며 프로덕션 환경의 동시성 요구사항에 따라 독립적으로 측정되어야 한다.

트레이드오프 분석에서 두 번째로 중요한 축은 '볼륨 경제성(Volume Economics)'과 조용한 병목인 '운영 오버헤드'다. Gemini Flash의 100만 입력 토큰당 비용이 $0.075 수준까지 하락한 현재, 전력비와 GPU 감가상각을 고려할 때 월 5,000만 토큰 이하의 처리 환경에서 '비용 절감'을 목적으로 하드웨어를 도입하는 것은 통계적 착각이다. 더불어 모델 업데이트, llama.cpp 버전 추적, 하드웨어 장애 복구 메커니즘 구축에 투입되는 엔지니어링 공수(Person-hours)를 정량화하면 로컬 LLM의 총소유비용(TCO)은 급격히 상승한다. 브런치 기사에서 지적하듯, 하드웨어를 먼저 구매하는 휴리스틱 접근을 버리고 타깃 모델의 메모리 요구량을 역산하여 하드웨어를 결정해야 실패 확률을 통제할 수 있다.

실무적인 시사점은 철저한 조건부 로직에 기반한 '하이브리드 라우팅(Hybrid Routing) 아키텍처'의 구축으로 귀결된다. 보안(Confidentiality)이 요구되는 데이터이거나 100ms 이하의 안정적인 P99 TTFT가 필요한 실시간 처리에는 로컬 7B/14B 모델을 할당하고, 대규모 컨텍스트 윈도우(50K 이상)나 병렬 배치(Batch) 처리가 요구되는 작업은 API로 넘기는 동적 라우팅이 필수적이다. 특히, 비용 제로인 로컬 모델에서 1차 추론을 수행한 후 자체 품질 평가 메트릭(예: Answer Relevance)이 임계치(Threshold) 0.75를 넘지 못할 때만 API로 폴백(Fallback)하는 '품질 에스컬레이션 체인(Quality Escalation Chain)'은 토큰 낭비를 최소화하면서도 생성 품질을 방어하는 가장 ROI가 높은 설계 패턴이다.

생성형 AI 시스템의 최적화는 벤더의 마케팅 용어가 아닌, 철저히 지연 시간과 리소스 사용량이라는 정량적 메트릭스에 기반해야 한다. 모델의 파라미터 크기, 양자화 수준, 그리고 대상 워크로드의 토큰 밀도를 독립 변수로 두고 인프라의 응답성을 종속 변수로 분석하는 체계적 접근만이 프로덕션 환경의 신뢰성을 담보한다. 앞으로의 AI 엔지니어링은 단일 환경에 대한 종속을 벗어나, 각 구성 요소를 독립적으로 측정하고 수학적으로 오케스트레이션하는 데이터 파이프라인 설계 역량에서 그 승패가 판가름 날 것이다.