생성형 AI 에이전트를 프로덕션 환경에 배포할 때 맞닥뜨리는 가장 큰 병목은 '컨텍스트 윈도우의 비효율성'과 '단일 거대 모델의 비용 구조'입니다. 많은 엔지니어들이 성능을 높이기 위해 프롬프트 엔지니어링에 매달리거나 무작정 더 큰 파라미터의 모델(예: Claude 3.5 Sonnet, GPT-4o)로 스위칭하려 합니다. 하지만 최근 개발자 커뮤니티(dev.to)를 통해 공개된 두 건의 벤치마크 데이터는, 모델의 규모(Scale)가 아닌 시스템 아키텍처 설계(Architecture Design)만으로도 비용-성능 트레이드오프를 극복할 수 있음을 명확한 수치로 증명하고 있습니다.

첫 번째 실험인 WebTaskBench 데이터는 에이전트의 '입력(Input) 파이프라인 최적화'에 관한 통찰을 제공합니다. 웹 페이지를 LLM에 전달할 때, 날것의 HTML은 평균 33,181토큰을 소모하며 80% 이상이 노이즈(CSS, 레이아웃 등)입니다. 반면 이를 SOM(Semantic Object Model, 의미론적 객체 모델) 형태의 구조화된 JSON으로 변환하면 8,301토큰으로 75%의 비용 절감이 가능합니다. 가장 흥미로운 지표는 추론 지연 시간(Latency)입니다. 토큰 수가 가장 적은 마크다운(4,542토큰)이 가장 빠를 것이라는 직관과 달리, GPT-4o 기준 마크다운은 1.9초, SOM은 1.4초의 응답 속도를 기록했습니다. 이는 요소의 의미와 상호작용 가능성("actions": ["click"])이 명시적으로 구조화된 SOM이 LLM의 내부 추론 사슬(Reasoning Chain)을 단축시켜 모호성을 제거했음을 시사합니다. 즉, 데이터 파이프라인의 전처리가 모델의 연산 부하를 직접적으로 낮춘 인과관계를 보여줍니다.

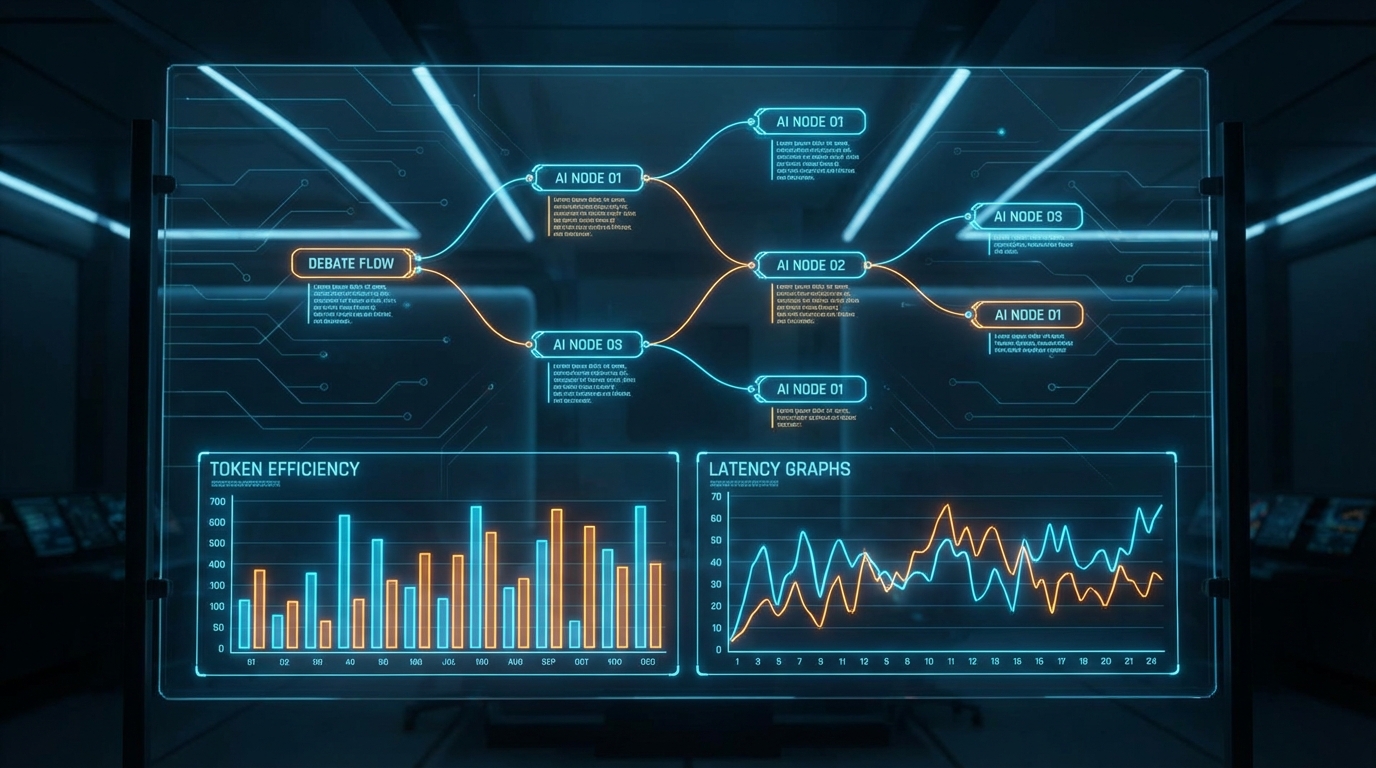

두 번째 실험인 MAGI 프레임워크 사례는 에이전트의 '오케스트레이션(Orchestration) 최적화'를 다룹니다. DeepSeek V3.2, MiMo-v2-pro, MiniMax M2.7 등 세 개의 저비용 모델을 앙상블하여 Claude Sonnet 4.6을 압도(88% vs 76%)한 이 실험의 핵심은 단순 다수결(Voting)이 아닌 '구조화된 토론(Iterative Consensus Ensemble)'에 있습니다. 동일한 모델 3개로 단순히 다수결을 진행했을 때는 정확도가 72%로 오히려 하락했습니다. 그러나 서로의 답변을 교차 검증하고 비판하게 한 토론 프로토콜에서는 88%로 상승했습니다. 다수결이 노이즈를 평균화하는 얕은 병합이라면, 토론은 모델이 논리적 결함에 강제로 개입하게 만드는 '수렴 조건(Convergence Condition)'으로 작용하기 때문입니다.

이 두 데이터가 에이전트 시스템 설계자에게 던지는 시사점은 명확합니다. 첫째, 토큰 최적화는 단순히 텍스트를 자르는 청킹(Chunking)이나 제거가 아니라, 모델이 파싱하기 쉬운 '시맨틱 구조화(SOM)'로 접근해야 P99 지연 시간을 낮출 수 있습니다. 둘째, 멀티 에이전트 시스템에서 라우팅 전략을 짤 때, 단일 모델에 페르소나만 다르게 부여하는 것은 통계적으로 무의미한 '연극'에 불과합니다. 학습 데이터 분포와 아키텍처가 완전히 다른 이기종(Heterogeneous) 모델 간의 '실질적 의견 불일치'를 설계해야만 앙상블의 진짜 효용을 얻을 수 있습니다. 단, MAGI 실험의 N=25라는 표본 크기는 통계적 유의성을 완벽히 담보하기엔 작으므로, 프로덕션 도입 시 대규모 데이터셋 기반의 재현성(Reproducibility) 검증이 반드시 선행되어야 합니다.

결론적으로, 신뢰성 있고 경제적인 생성형 AI 시스템을 구축하는 싸움은 점차 모델의 성능 경쟁에서 '에이전트 인프라스트럭처 경쟁'으로 이동하고 있습니다. 값비싼 SOTA 모델의 API 호출에 의존하기보다, 입력 컨텍스트의 정보 밀도를 높이는 SOM 기술과, 저렴한 오픈소스 모델 간의 구조적 합의를 이끌어내는 라우팅 파이프라인을 구축하는 것. 이것이 데이터 중심의 엄밀한 AgentOps 환경에서 비용과 성능을 동시에 통제하는 가장 수학적이고 실무적인 해답입니다.