AI 추론 단가가 90% 떨어져도 기업의 AI 비용은 쉽게 줄지 않습니다. 가트너는 2030년까지 1조 파라미터 모델 추론비가 급감하더라도, 에이전트 확산으로 ‘작업당 토큰 사용량’이 5~30배 늘어 총비용이 오를 수 있다고 봤습니다(zdnet의 가트너 인용 보도). 이제 성장의 병목은 “모델이 똑똑한가”가 아니라 “한 번의 전환을 만들기 위해 토큰을 얼마나 태우고, 얼마나 자주 실패하느냐”로 이동합니다.

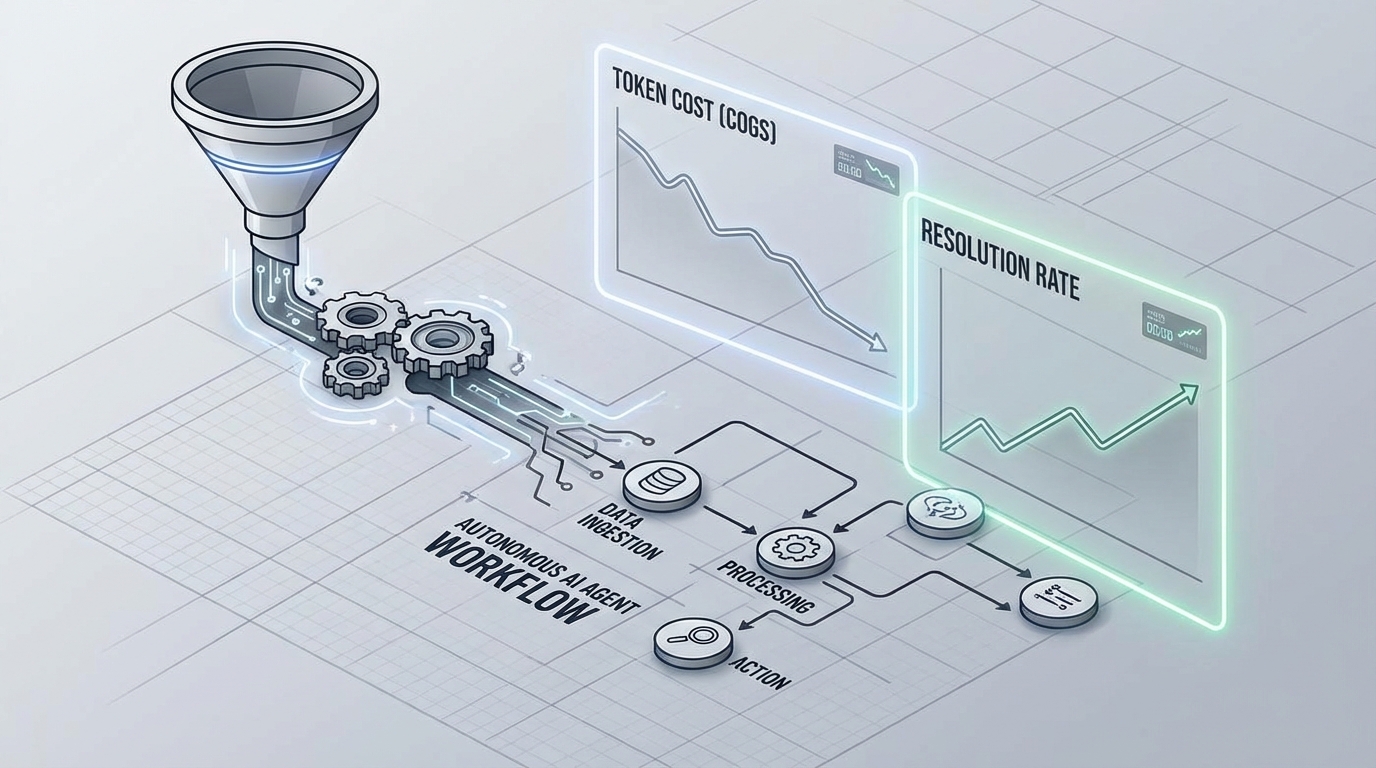

핵심은 에이전트 COGS×해결률입니다. 여기서 COGS는 토큰/추론비뿐 아니라 재시도·타임아웃·툴 호출·관측(로그/트레이싱)까지 포함한 ‘실제 실행 비용’이고, 해결률은 사용자가 기대한 작업을 오류 없이, 결정적으로, 납득 가능한 결과로 끝내는 비율입니다. 두 값의 곱이 커지면 CAC는 올라가고, 전환율과 리텐션은 동시에 깎입니다. 에이전트는 상단 퍼널의 “탐색”을 하면서도 하단 퍼널의 “결정/실행(구매, 예약, CRM 기록)”을 건드리기 때문에, 실패가 곧바로 매출 손실로 번역됩니다.

맥락을 더 날카롭게 보면, 토큰 단가 하락은 ‘단가’만 낮출 뿐 토큰 소비량을 폭증시키는 구조를 바꾸지 못합니다. 에이전트는 (1) 장문 컨텍스트, (2) 멀티스텝 추론, (3) 툴/웹/API 왕복, (4) 실패 시 재시도 루프를 기본값으로 갖습니다. dev.to의 프로덕션 에이전트 경험담이 말하듯, 실제 코드는 기능보다 에러 핸들링/리트라이/결정성 확보가 더 큽니다. 이 영역이 정교하지 않으면, 에이전트는 ‘조용히 실패하며 토큰을 태우는’ 비용 엔진이 됩니다.

시사점은 명확합니다. 첫째, 비용 최적화의 단위가 “모델 교체”에서 “워크플로우 단위의 라우팅”으로 바뀝니다. 가트너가 제시한 멀티 모델 오케스트레이션이 여기서 효율을 만듭니다: 반복·정형 작업은 소형/도메인 모델로, 불확실성이 높은 구간만 프런티어 모델로 올립니다. 둘째, 해결률은 프롬프트가 아니라 시스템 설계 지표로 관리해야 합니다. 결정성 사다리(규칙·스크립트·검증 로직을 위로 올리기), 2회 동일 실패 시 즉시 중단(fail fast), 툴 호출 멱등성, 사람 개입(HITL) 임계값 같은 ‘운영 장치’가 전환을 지킵니다.

실행 가능한 실험 프레임을 제안합니다. A/B 테스트의 1차 목표를 “정확도”가 아니라 단위 전환당 COGS와 해결률로 두세요. 예: (A) 항상 프런티어 모델 vs (B) 소형→대형 업그레이드 라우팅. 관측 지표는 ①Task Success Rate(최종 산출 완료), ②Silent Failure Rate(사용자에게 성공처럼 보이나 결과가 비어있거나 지연), ③Retry Tokens/Task(재시도로 소모된 토큰), ④Time-to-Resolution, ⑤Escalation Rate(HITL 비율), ⑥Gross Margin per Conversion(전환당 마진)입니다. 여기서 핵심 KPI는 (전환율 × ARPU) − (전환당 COGS)로 두면, “더 똑똑하지만 비싼 에이전트”의 착시를 바로 잡을 수 있습니다.

전망: 에이전트가 퍼널에 깊게 들어갈수록, 시장은 ‘최고 모델’보다 최고 운영’(신뢰성·결정성·비용 통제)을 가진 팀이 가져갑니다. 토큰이 싸질수록 경쟁자는 더 많은 토큰을 쓰며 기능을 밀어 넣을 것이고, 그 순간 차별화는 “얼마나 적게 태우고(=COGS), 얼마나 자주 해결하느냐(=해결률)”로 결정됩니다. 다음 분기 성장 과제는 모델 업그레이드가 아니라, 에이전트를 비용-신뢰성-전환 지표로 묶어 실험 가능한 시스템으로 재설계하는 것입니다.