LLM 추론 시스템, 특히 토큰 생성(Decoding) 단계의 절대적 병목은 연산량(Compute)이 아니라 메모리 대역폭(Memory Bandwidth)이다. 최근 dev.to에 공개된 벤치마크 데이터는 이 물리적 한계를 극명하게 보여준다. 데이터센터의 HBM4가 22TB/s의 대역폭으로 진화하는 동안, 컨슈머용 GDDR7은 버스 폭(Bus Width)의 물리적 제약으로 인해 448GB/s 수준에 머물며 그 격차가 2026년 기준 49배까지 벌어질 전망이다. 이는 프로덕션 및 로컬 엣지 환경에서 모델 스케일업이 곧바로 서빙 레이턴시의 치명적 저하로 직결됨을 의미한다.

이러한 대역폭의 구조적 한계 속에서, 양자화(Quantization)는 단순한 용량 압축이 아닌 '수학적 대역폭 확장(Bandwidth Hack)'으로 재해석되어야 한다. 16-bit 모델을 Q4_K_M으로 양자화하여 1/4 크기로 줄이는 것은, VRAM에서 가중치를 읽어오는 유효 대역폭을 4배로 늘리는 것과 정확히 동일한 효과를 낸다. RTX 4060 8GB(대역폭 272GB/s) 환경에서 이론적 토큰 생성 속도가 15 tok/s에서 60 tok/s로 4배 상승하는 정량적 근거가 바로 여기에 있다. 컴퓨팅 리소스가 제한된 환경에서 양자화는 선택이 아닌 필수적인 대역폭 최적화 파이프라인이다.

그러나 진정한 패러다임 전환은 VRAM 용량을 초과하는 모델을 서빙할 때 아키텍처(Dense vs MoE)가 만드는 효율성 격차에서 발생한다. 8GB VRAM 실측 데이터에 따르면, 27B 규모의 Dense 모델(Qwen3.5-27B)은 파라미터 전체를 GPU에 적재하지 못해 58개 레이어 중 24개만 오프로드하며 3.57 tok/s라는 절망적인 처리량을 기록했다. 이때 GPU 활용률은 60%에 불과했으며, 나머지 40%는 CPU-GPU 간 데이터 전송 대기(I/O Wait)로 인해 낭비되었다. 메모리 페이징이 추론 성능을 붕괴시킨 전형적인 사례다.

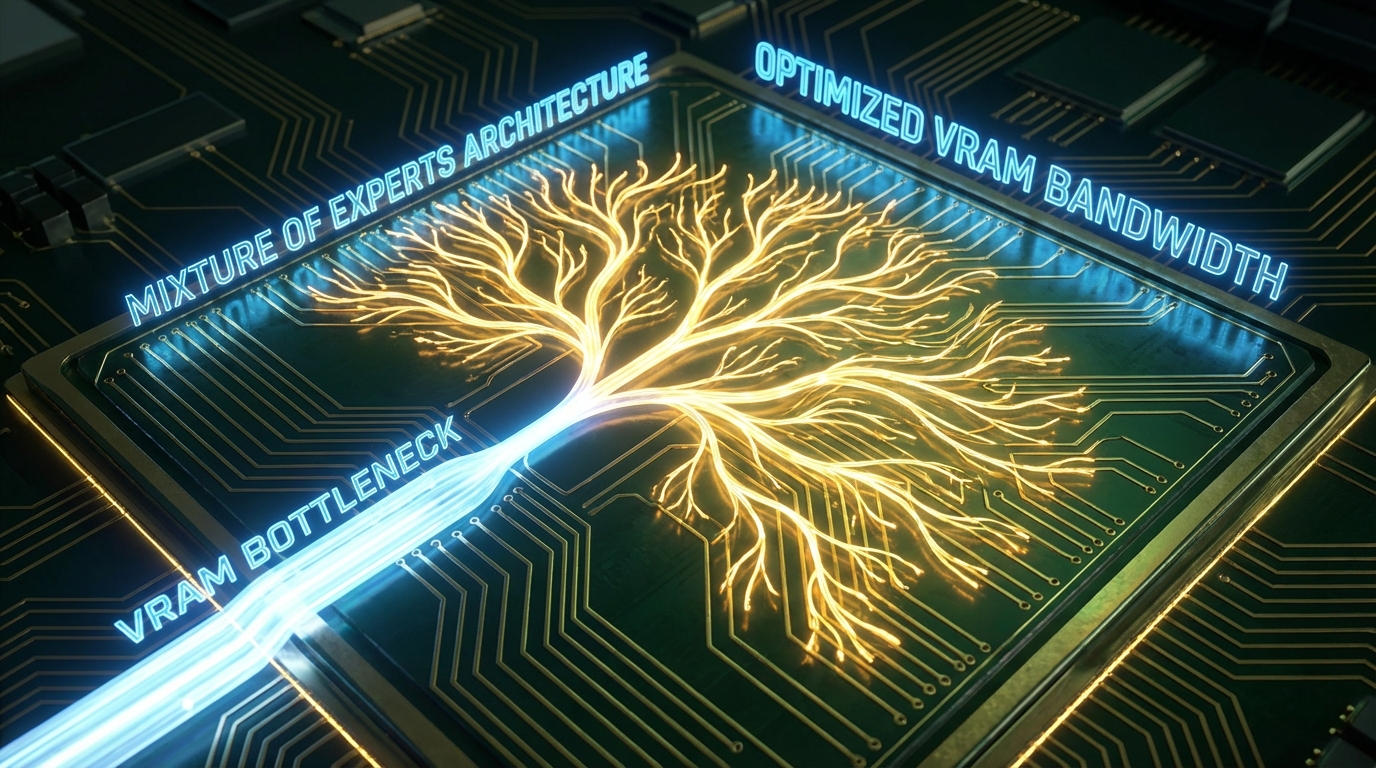

반면, 파라미터 규모가 더 큰 35B MoE 모델(Qwen3.5-35B-A3B)은 동일 환경에서 8.61 tok/s를 달성하며 Dense 대비 2.4배의 처리량 향상을 입증했다. 핵심은 8.6%에 불과한 활성화 비율(Activation Ratio)이다. 토큰당 전체 35B 중 단 3B의 활성 전문가(Active Experts) 파라미터만 VRAM으로 라우팅되고, 나머지 비활성 가중치는 시스템 RAM에 대기한다. 결과적으로 GPU 파이프라인은 95%의 최적 활용률을 유지하며 VRAM의 물리적 한계를 완벽히 우회한다. "MoE는 VRAM이 풍부할 때만 유리하다"는 기존 문헌의 통념은 폐기되어야 한다. 실증 데이터는 두 모델 모두 VRAM 용량을 초과할 때, 오히려 MoE가 압도적인 우위를 점함을 증명한다.

물론 이 최적화에는 엄밀한 비용-성능 트레이드오프가 수반된다. 비활성 전문가 가중치를 보관하기 위해 30.8GB의 막대한 시스템 RAM이 강제되며, 모델의 깊은 추론이 컨텍스트 윈도우를 20분 만에 고갈시키는 병목 현상도 관측되었다. 따라서 향후 생성형 AI 시스템의 설계는 VRAM 용량 증설이라는 단순한 해법을 넘어, DeepSeek-V3처럼 활성화 비율을 5.5% 수준까지 극단적으로 낮추는 '파라미터 세분화 및 라우팅 알고리즘 최적화'에 집중해야 한다. 이제 AI 시스템 엔지니어의 핵심 평가 지표는 단순한 파라미터 크기가 아닌, '활성 토큰당 VRAM 대역폭 점유율'이 되어야 한다.