OpenAI가 서울에서 국내 CTO 120여 명을 모아 'Codex CTO 포럼'을 열었다. 핵심 메시지는 단순했다. AI는 이제 코드 자동완성 도구가 아니라 '위임형 팀메이트'라는 것. 실제로 개발 업무를 넘겨받아 처리하는 에이전트 시대가 시작됐다는 선언이다. 발표장 분위기는 낙관적이었다고 한다.

그런데 같은 시기, dev.to에 조용히 올라온 글 하나가 그 낙관론에 찬물을 끼얹는다. 필자는 실제 백로그에서 뽑은 10개 태스크를 Devin에게 넘겼다. 장난감 문제가 아니었다. 버그 픽스, DB 마이그레이션, 웹훅 핸들러, 테스트 스위트, 리팩토링, 캐싱 레이어 설계—팀 주니어 개발자라면 충분히 처리할 수 있는 실제 티켓들이었다. 결과는 10개 중 3개 완료, 30% 성공률이었다.

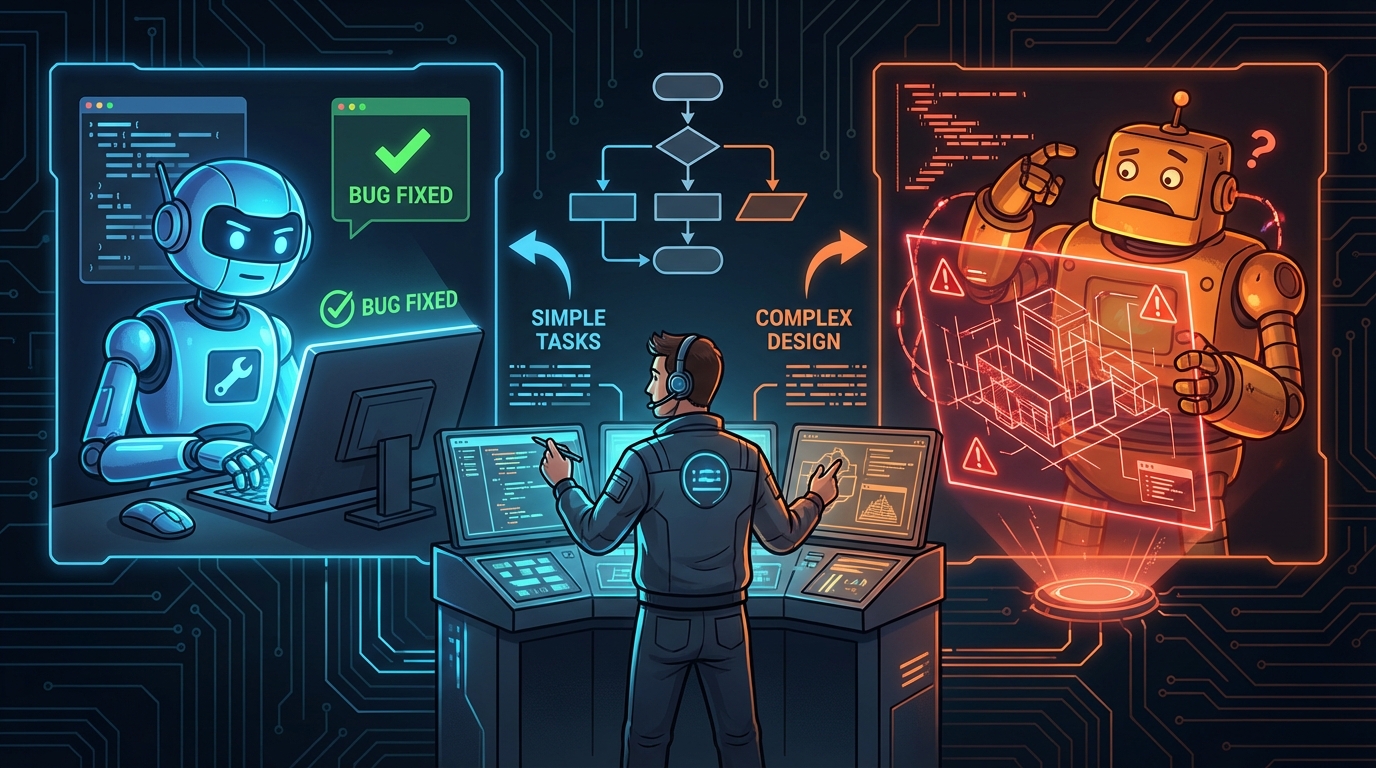

숫자만 보면 실망스럽다. 하지만 패턴을 보면 더 중요한 걸 발견할 수 있다. Devin이 성공한 3개는 공통점이 있다. 버그 두 건과 테스트 스위트 하나—모두 문제 범위가 명확하게 닫혀 있고, 판단보다 탐색이 필요한 태스크였다. 날짜 파싱 버그에서 DST 엣지 케이스를 찾아낸 건 인상적이었다. 반면 실패한 7개는 다 판단이 필요한 순간에 무너졌다. DB 마이그레이션에서는 값을 자르고 컬럼을 드롭했다—프로덕션이었으면 수천 건의 레코드가 날아갔을 것이다. 웹훅 핸들러에서는 동기/비동기 처리 방식을 결정하지 못하고 두 패턴을 동시에 구현해놨다. 멀티테넌트 캐싱 태스크는 그냥 단일 테넌트 인메모리 캐시를 내놨다. 요구사항 자체를 이해하지 못한 것이다.

Devin의 SWE-bench 스코어는 13.86%다. 숙련 개발자가 동일 벤치마크에서 50~70%를 기록한다는 점을 감안하면, 현재 에이전트의 실제 능력치가 어디쯤인지 가늠이 된다. Devin은 출시 당시 월 500달러였다가 지금은 20달러로 내려왔다. 그 가격 하락 자체가 시장의 평가다. 필자의 결론은 명확했다. "AI 소프트웨어 엔지니어"와 "AI 코드 어시스턴트" 사이의 간극은 여전히 크고, 지금 당장 더 많은 가치를 내는 건 인간을 루프 안에 두는 어시스턴트 모델이라는 것.

그렇다면 에이전트에게 무엇을 위임할 수 있나? 이 질문에 대한 가장 실용적인 프레임을 제공한 건 dev.to의 또 다른 글, "Software Development in the Agentic Era"다. 핵심 명제는 이렇다. AI는 좋은 엔지니어링을 바꾸지 않는다. 좋은 엔지니어링과 나쁜 엔지니어링의 결과가 더 빨리 도착하게 만들 뿐이다. DORA의 2025 AI-Assisted 개발 보고서도 같은 결론을 냈다. AI로 성과를 낸 팀들은 이미 고성능 팀이었다. 작은 배치, 빠른 피드백 루프, 지속적 통합이 되어 있는 팀은 부스트를 받았고, 그렇지 않은 팀은 오히려 다운스트림 혼란이 늘었다.

이게 AI-First 팀 리빌딩에서 내가 가장 강조하는 지점이다. 에이전트를 도입하기 전에 코드베이스가 에이전트와 협업할 수 있는 구조인지를 먼저 따져야 한다. 에이전틱 시대에 코드베이스는 단순히 소스코드 저장소가 아니라 에이전트에게 보내는 가장 중요한 프롬프트다. 모듈 경계가 명확하고, 테스트가 빠르고 결정론적이며, ADR(Architecture Decision Records)로 왜 그 결정을 했는지 기록되어 있는 코드베이스에서 에이전트는 훨씬 잘 작동한다. 반대로 레거시 모놀리스에 테스트도 없고 암묵적 지식만 가득한 코드베이스에서는? 에이전트는 그냥 더 많은 버그를 더 빠르게 만들어낼 뿐이다.

인식 갭(perception gap)도 냉정하게 봐야 한다. METR의 RCT 연구에서 개발자들은 AI가 자신을 약 20% 빠르게 해줬다고 느꼈지만, 실제 측정 결과는 오히려 느려진 케이스도 나왔다. 에이전트가 10분 만에 태스크를 완료하면 마법처럼 느껴지지만, 이후 30분을 리뷰하고 픽스하는 데 쓰면 총 시간은 마이너스다. 그리고 그 사실을 개발자 본인도 잘 인지하지 못한다. PR 수, 커밋 수 같은 표면 지표가 올라가면 팀은 AI가 효과가 있다고 착각하기 쉽다. 측정해야 할 건 리드타임, 변경 실패율, 배포 빈도다.

그럼 AI-First 팀은 어떻게 설계해야 하나? 내가 현장에서 쓰는 기준은 세 가지다. 첫째, 위임 가능한 태스크를 사전에 분류한다. Devin 실험이 증명했듯, 범위가 닫혀 있고 판단보다 탐색이 필요한 태스크—버그 픽스, 보일러플레이트 생성, 기계적 마이그레이션, 기존 코드의 테스트 스위트 작성—는 에이전트에게 넘길 수 있다. 아키텍처 결정, 트레이드오프 판단, 멀티테넌트처럼 요구사항의 맥락 이해가 필요한 태스크는 아직 인간이 주도해야 한다. 둘째, 에이전트를 루프 밖에 두지 않는다. Devin처럼 완전 자율형으로 쓰기보다 Claude Code처럼 인간이 방향을 잡고 에이전트가 실행하는 협업 모델이 복잡한 태스크에서 더 높은 성공률을 낸다. 15분 협업이 5분 디스패치 후 45분 수습보다 낫다. 셋째, 코드베이스를 에이전트 친화적으로 유지하는 걸 팀의 기술 부채 기준에 포함시킨다. AGENTS.md, CLAUDE.md 같은 컨텍스트 파일 관리, ADR 작성, 테스트 속도 유지는 이제 단순한 개발 위생이 아니라 AI 협업 인프라다.

전망은 이렇다. 에이전트 성능은 계속 올라갈 것이다. Cognition은 Devin 2.0을 내놓으면서 속도와 IDE 경험을 개선했고, OpenAI Codex는 위임형 모델을 본격화하고 있다. 하지만 성능 곡선이 올라가는 속도와 무관하게, 에이전트 위임 한계는 에이전트의 능력치만으로 결정되지 않는다. 그걸 받아내는 팀의 구조, 코드베이스의 상태, 위임 범위를 설계하는 기술 리더의 판단이 함께 작동해야 한다. OpenAI 포럼에서 '위임형 팀메이트 시대가 왔다'고 선언하는 건 맞다. 다만 그 팀메이트를 제대로 쓰려면, 팀 자체가 먼저 그걸 받을 수 있는 구조여야 한다는 전제가 빠져 있다. 그게 지금 AI-First 리빌딩에서 가장 먼저 해결해야 할 문제다.