프로덕션 환경에서 LLM API 비용은 결코 선형적으로 예측되지 않는다. 입력 컨텍스트 길이, 멀티모달 데이터(이미지, 오디오), 그리고 128k 토큰 임계점을 기점으로 변동되는 동적 과금 체계는 기존의 클라우드 인프라 예산 모델을 완전히 무너뜨린다. 최근 dev.to를 통해 공개된 오픈소스 LLM 게이트웨이 'Bifrost'의 아키텍처는 AgentOps와 MLOps 관점에서 매우 중요한 화두를 던진다. 단순한 모델 라우팅을 넘어, 애플리케이션 코드가 아닌 게이트웨이 계층에서 요청 단위(per-request)의 정밀한 비용 추적과 실시간 예산 통제가 이루어져야 한다는 데이터 중심적 접근을 보여준다.

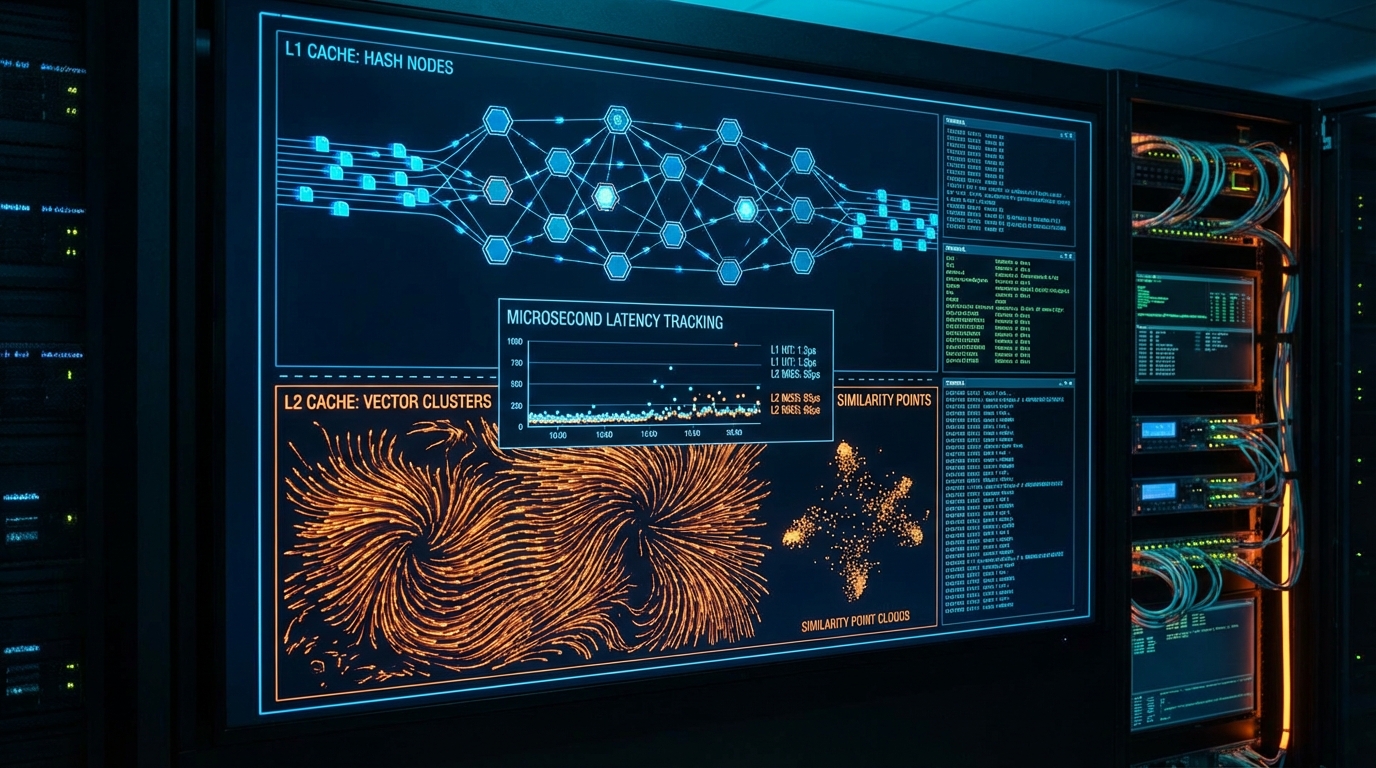

이 시스템에서 가장 엄밀하게 평가해야 할 정량적 지표는 로깅 시 발생하는 '11마이크로초(µs)'의 지연 시간(Latency) 오버헤드다. 프로덕션 환경에서 LLM API의 P99 응답 시간이 통상 수 초(Seconds)에 달함을 감안할 때, 11µs는 전체 파이프라인에서 통계적으로 무의미한 수준의 병목이다. 이는 모델 프라이싱 데이터를 O(1) 복잡도의 인메모리 구조로 적재하여 산출한 결과로, '관측성(Observability) 확보가 추론 속도를 저해한다'는 트레이드오프를 구조적으로 타파했다. 특히 '캐시 인식(Cache-aware) 비용 추적'은 실무적으로 매우 치밀한 설계다. 기존 모니터링 툴처럼 캐시 히트된 요청을 원본 모델의 토큰 비용으로 역산하게 되면 ROI 리포트가 심각하게 왜곡되고 모델 최적화 지표가 오염되기 때문이다.

Bifrost가 채택한 '이중 레이어 시맨틱 캐싱(Dual-layer Semantic Caching)'은 비용과 성능 간의 수학적 트레이드오프를 극명하게 보여준다. 1계층인 정확한 해시 매칭(Exact Hash)은 연산 비용과 지연 시간이 'Zero'에 수렴하지만, 사용자 프롬프트의 띄어쓰기나 미세한 변형에 취약해 실제 히트율이 낮다. 이를 보완하는 2계층 시맨틱 캐싱은 Weaviate 같은 벡터 DB를 활용하는데, 여기서 철저한 손익분기점 계산이 필요하다. 임베딩 모델(예: text-embedding-3-small) 호출 비용과 벡터 검색 레이턴시의 합이, 원본 LLM의 추론 비용 및 생성 레이턴시의 합보다 명확히 작아야만 경제성이 성립한다. 또한, 코사인 유사도 임계값(Threshold)을 0.8로 설정했을 때 발생하는 False Positive(오매칭) 비율이 RAG의 응답 신뢰성(Faithfulness)에 미치는 영향을 독립적인 A/B 테스트로 반드시 검증해야 한다.

멀티 에이전트(Multi-Agent) 시스템이 고도화될수록 게이트웨이는 단순한 프록시를 넘어 '비용 및 인지 라우팅'을 결정하는 두뇌가 될 것이다. 에이전트의 자율적인 툴 선택(Tool Selection)이나 무한 루프에 빠진 재시도(Retry) 과정에서 발생하는 치명적인 토큰 누수를 방어하려면, 고객-팀-가상키-프로바이더로 이어지는 다중 예산 계층에서 한도 초과 시 즉각적으로 요청을 차단하는 하드 리밋(Hard Limit) 서킷 브레이커가 필수적이다. 각 구성 요소의 토큰 효율성과 P99 지연 시간을 정량적으로 측정하고 캐싱 전략을 최적화하지 않는다면, 생성형 AI 서비스의 트래픽 확장은 곧 재무적 재앙으로 직결될 것이다.