AI 코딩 도구 도입을 결정하는 순간, 대부분의 팀은 "어떤 도구가 가장 좋은가"를 먼저 묻는다. 틀린 질문이다. dev.to에 공개된 세 편의 현장 보고서를 교차 분석하면 더 중요한 질문이 선명해진다. "우리 팀이 저지를 수 있는 실패 패턴을 알고 있는가."

도구 선택보다 실패 패턴 인식이 먼저다. 순서를 바꾸면 비용도, 시간도 달라진다.

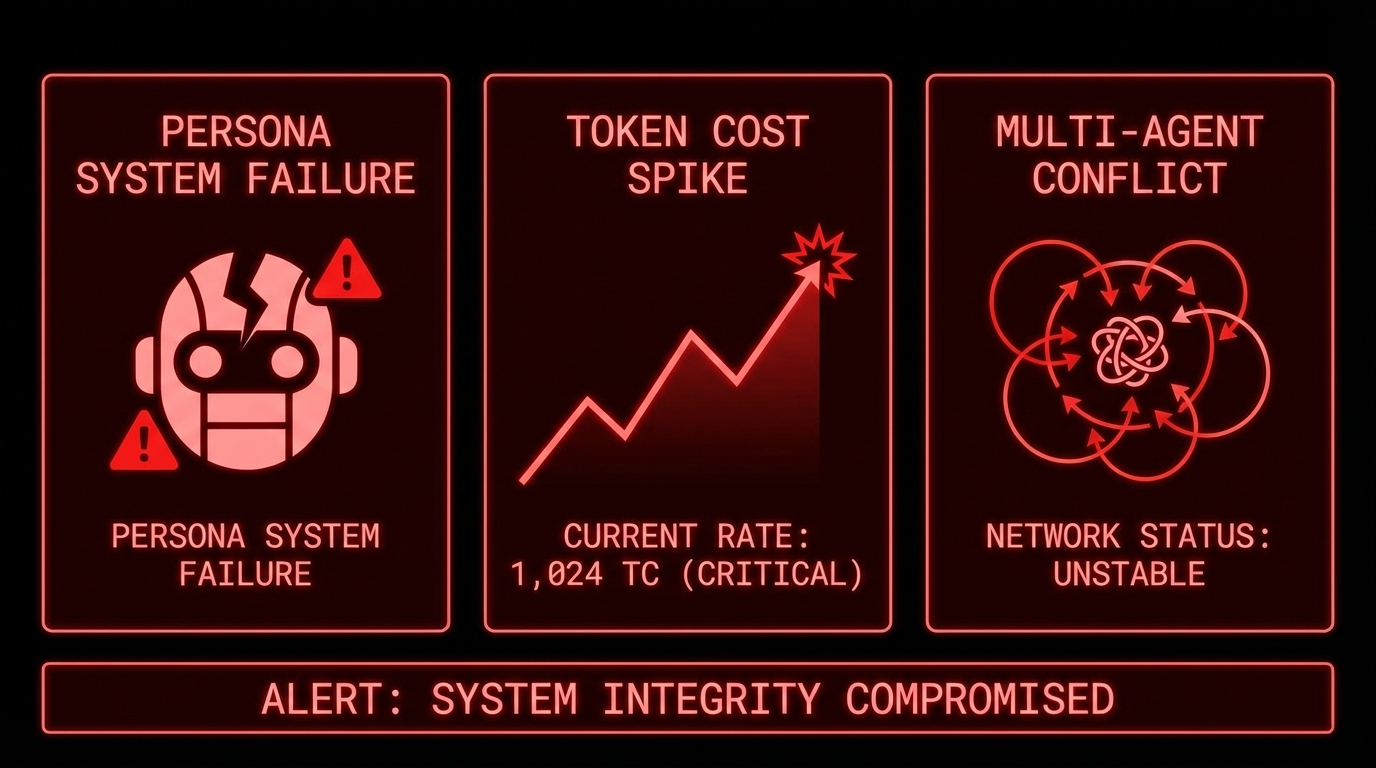

실패 패턴 1. 페르소나 과잉 — 정성껏 쓴 프롬프트가 품질을 갉아먹는다

Claude Code 사용자 커뮤니티에서 광범위하게 퍼진 조언이 있다. "AI에게 '세계 최고의 시니어 엔지니어'라는 정체성을 부여하면 더 좋은 코드가 나온다." 17편의 아카이브 논문을 검토한 한 개발자가 이를 정면으로 반박했다. (출처: Stop Using Elaborate Personas, dev.to)

PRISM 페르소나 연구와 DeepMind(2025) 논문을 종합한 결과는 직관과 반대다. 장황한 역할 부여는 모델의 훈련 데이터 중 마케팅·동기부여 텍스트를 활성화해 기술적 정밀도를 떨어뜨린다. 50토큰 이하의 짧고 기능적인 정체성이 일관되게 더 높은 품질을 보였다.

시스템 프롬프트 길이도 마찬가지다. 요구사항이 19개를 넘어서면 5개만 있을 때보다 정확도가 낮아진다. 지시가 많아질수록 지시 충돌(instruction collision)이 발생하고, 모델은 어느 지시를 따를지 혼란에 빠진다. "더 자세히 알려줄수록 더 잘 한다"는 믿음은 현장 데이터 앞에서 무너진다.

팀 적용 원칙: CLAUDE.md나 시스템 프롬프트를 리뷰할 때 페르소나 문장과 요구사항 개수를 먼저 세라. 50토큰 초과 페르소나는 삭제, 요구사항 10개 초과분은 우선순위를 매겨 절반을 잘라낸다.

실패 패턴 2. 다중 에이전트 환상 — 에이전트가 많을수록 좋다는 착각

같은 연구에서 나온 멀티 에이전트 경제학 수치가 더 충격적이다. 5개 에이전트 팀은 단일 에이전트 대비 토큰 비용이 7배지만 산출물은 3.1배에 그친다. 7개를 넘어가면 4개 팀보다 오히려 결과물이 줄어드는 역전 현상도 관찰됐다.

구조적 원인은 '고무도장 LGTM'이다. 리뷰 에이전트가 저항 없이 동의하는 쪽을 택하면 다중 에이전트 구조는 품질 필터가 아니라 비용 증폭기로 전락한다. MIT 연구는 컨텍스트 중간부에 핵심 정보가 위치할 때 정확도가 30% 이상 하락하는 아키텍처 원인도 짚어냈다. 에이전트를 늘리기 전에 단일 에이전트가 최적 성능의 45%를 달성하는지부터 측정하라는 '45% 임계치 규칙'은 이 맥락에서 나왔다.

팀 적용 원칙: 다중 에이전트 워크플로우 도입 제안이 나오면 먼저 물어라. "단일 에이전트 성능을 측정했는가?" 정량 데이터 없이 에이전트 수를 늘리는 결정은 비용만 키운다.

실패 패턴 3. 과금 구조 무지 — 청구서가 날아오기 전까지 아무도 모른다

한 개발자가 4주 만에 Cursor 청구서로 11,922달러를 받은 사례는 단순한 개인 실수가 아니다. (출처: I Spent $11,922 on Cursor in Under 4 Weeks, dev.to) 이 사례가 팀 도입 관점에서 중요한 이유는 실패의 구조가 반복 가능하기 때문이다.

청구 주기 1(2주): 4,339달러. 청구 주기 2(1.5주): 7,583달러. 요청 수는 두 번째 주기에서 오히려 절반 가까이 줄었지만 토큰은 4배 폭증했다. 에이전트 세션이 길어질수록 컨텍스트가 누적되고, 토큰 비용이 기하급수적으로 복리된다. 플랫폼이 사용량에 상한을 두지 않는 구조에서는 이 패턴이 언제든 재현될 수 있다.

해결책으로 선택한 건 Claude Code Max 계정 3개, 월 600달러 정액제였다. 비용은 95% 절감됐고, 12개 이상 병렬 터미널 세션이라는 더 확장된 워크플로우를 유지했다. 단, 상쇄 비용도 실재한다. IDE 인라인 자동완성의 몰입감과 시각적 컨텍스트는 터미널 네이티브 도구로 대체되지 않는다.

팀 적용 원칙: 도구 도입 전 과금 구조를 세 가지 시나리오로 시뮬레이션하라. 라이트 사용, 정상 사용, 그리고 팀원 한 명이 병렬 에이전트를 풀로 돌리는 극단 케이스. 마지막 시나리오에 상한이 없다면 청구 알림 임계값 설정은 선택이 아니라 필수다.

맥락 해석 — 세 실패의 공통 원인

세 실패 패턴의 뿌리는 하나다. AI 도구를 블랙박스로 신뢰하고 제어 설계를 미뤘다. 페르소나 남용은 프롬프트 작성자가 모델 내부 동작을 이해하지 못한 결과다. 다중 에이전트 환상은 복잡성이 곧 품질이라는 직관적 오류에서 온다. 토큰 비용 폭탄은 과금 모델을 끝까지 읽지 않은 팀의 운영 미스다.

도구 비교 연구(dev.to, Best AI Coding Agents: 9 Tools Compared)가 제시하는 9개 도구 중 어느 것을 선택하든, 이 세 가지 실패 패턴에 대한 팀의 인식이 없으면 도구 교체는 문제를 이전할 뿐 해결하지 않는다. SWE-bench 80.8%를 기록한 Claude Code든, 100만 사용자를 보유한 Cursor든, 도구의 벤치마크 점수는 팀의 운영 판단을 대신하지 못한다.

전망 — AI-First 도입의 실질적 순서

2026년 기준 AI 코딩 도구 시장은 128억 달러 규모로 2년 새 2.5배 성장했다. 개발자의 85%가 이미 사용 중이거나 도입을 계획하고 있다. 이 숫자는 "도입하느냐 마느냐"의 논쟁을 무의미하게 만든다.

남은 질문은 실행 순서다. 실패 패턴을 먼저 인식하고, 과금 구조를 시뮬레이션하고, 단일 에이전트 성능을 측정한 뒤 확장을 결정하는 것. 이 순서를 지킨 팀과 그렇지 않은 팀의 격차는 도구 선택의 차이보다 훨씬 크다. 좋은 도구는 올바른 운영 설계 위에서만 ROI를 만든다.